메타가 4조원에 인수한 Manus의 기술, 오픈소스로 풀리다

지난 12월 29일, Meta가 싱가포르 기반 AI 스타트업 Manus를 인수했습니다. 출시 8개월 만에 연간 매출 1억 달러를 달성한 회사예요. Manus는 단순한 챗봇이 아니었어요. 복잡한 리서치, 코딩, 데이터 분석 같은 다단계 작업을 자율적으로 완수하는 AI 에이전트였습니다. OpenAI의 Deep Research를 GAIA 벤치마크에서 10% 이상 앞섰고, 147조 토큰을 처리하며 많은 사람들의 작업 처리를 도와주었어요. 이 기업의 핵심 기술 중 하나가 모든 사람들이 활용할 수 있도록 한 깃헙 사옹자가 최근에 오픈소스로 기술을 공개했습니다.

😤 AI 에이전트의 고질병과 해결책

Claude Code를 포함한 대부분의 AI 에이전트들은 이런 문제를 겪어요.

- 휘발성 메모리 — 컨텍스트가 리셋되면 이전 작업 내용이 사라집니다.

- 목표 이탈 — 50번 이상 도구를 호출하다 보면 원래 목표를 까먹어요.

- 숨겨진 에러 — 실패가 기록되지 않아서 같은 실수를 반복합니다.

- 컨텍스트 과부하 — 모든 정보를 컨텍스트에 우겨넣다가 한계에 부딪히죠.

이 문제를 해결하기 위해 GitHub 사용자 OthmanAdi가 Manus의 워크플로우를 Claude Skills로 구현했어요. 워크플로우는 간단해요. 이 Claude Skills를 사용하면, 클로드는 다음 세 가지 파일들을 생성/수정하며 워크플로우를 진행하게 됩니다.

task_plan.md → 단계와 진행 상황 추적

notes.md → 리서치 결과 저장

[deliverable].md → 최종 산출물- task_plan.md에 목표와 단계를 작성

- 리서치 → notes.md에 저장 → task_plan.md 업데이트

- notes.md 읽기 → 산출물 생성 → task_plan.md 업데이트

- 최종 결과물 전달

📚 Claude Skills가 뭔가요?

Claude Skills는 MCP에 이어 Anthropic이 내놓은 새로운 컨텍스트 관리 툴이에요. Skills는 Claude의 기능을 확장하는 모듈형 패키지입니다. 특정 도메인의 전문 지식과 워크플로우를 Claude에게 제공해서 범용 AI를 특화된 전문가로 만들어줘요. 매번 같은 지시사항을 반복하는 대신, 한 번 패키징해두면 Claude가 자동으로 Skills를 활성화해서 작업을 처리할 수 있게 되요.

직접 개인 프로젝트에 이 Claude Skills를 적용하고 싶다면 이 레포지토리를 통해 확인해볼 수 있어요

AI로 숙제하는 학생들, AI로 시험 보게 하다.

요즘 대학 캠퍼스에서 ChatGPT나 Claude 같은 LLM을 활용하지 않는 학생을 찾기가 더 어려워졌어요. 과제 작성, 논문 요약, 코딩 숙제까지 AI의 도움을 받는 게 일상이 되었죠. 문제는 이런 환경에서 학생들이 실제로 학습 내용을 이해했는지 판단하기가 점점 어려워지고 있다는 거예요. NYU 비즈니스 스쿨에서 "AI/ML 프로덕트 매니지먼트" 수업을 가르치는 Panos Ipeirotis 교수도 같은 고민에 빠졌어요. 학생들이 제출한 과제들은 완벽했지만, LLM이 숙제를 대신 작성해주는 세상에서 학생들이 실제로 이해하면서 숙제를 완료했는지 알 방법이 없었거든요. 그래서 수업 중에 무작위로 학생들을 지목해서 질문을 던졌는데, 충격적이게도 많은 학생들이 자신이 제출한 과제의 기본적인 내용조차 설명하지 못했어요. AI가 숙제를 완벽하게 완료해주는 시대에, 기존의 평가 방식은 더 이상 학생의 실제 이해도를 측정하지 못하게 된 거에요.

Ipeirotis 교수는 이 문제를 해결하기 위해 역발상을 했어요. AI로 숙제하는 학생들을, AI로 시험 보게 하자는 거였죠. 그는 ElevenLabs의 Conversational AI 플랫폼을 활용해서 음성 기반 구술 시험 시스템을 구축했어요. 이 시스템은 세 개의 서브 에이전트로 구성되어 있는데요. 먼저 인증 에이전트가 학생 신분을 확인하고, 프로젝트 토론 에이전트가 학생별 캡스톤 프로젝트에 대해 심층 질문을 던지고, 마지막으로 케이스 토론 에이전트가 수업에서 다룬 사례 연구를 바탕으로 질문해요. 핵심은 각 학생의 프로젝트 정보가 파라미터로 주입되어서 완전히 개인화된 질문이 생성된다는 점이에요. LLM이 숙제를 대신 해줬다면, 실시간으로 자기 프로젝트에 대한 구체적인 질문에 일관성 있게 답하기는 거의 불가능하거든요. 채점 방식도 흥미로워요. Andrej Karpathy가 제안한 "LLM 위원회(Council of LLMs)" 방식을 적용했는데요. Claude, Gemini, ChatGPT 세 모델이 각각 독립적으로 시험 트랜스크립트를 채점한 뒤, 서로의 평가를 공유하고 다시 수정하는 방식이에요.

결과는 꽤 흥미로워요. 36명의 학생을 9일에 걸쳐 시험했는데, 학생당 비용은 단 0.42달러(총 15달러)였어요. 같은 시험을 인간이 진행했다면 30시간의 인력이 필요했을 거예요. LLM 채점의 89%가 1점 차이 이내로 일치했고, 흥미롭게도 가장 짧은 시험(9분)을 본 학생이 가장 높은 점수(19/20)를 받았어요. 아는 사람은 빠르게 답하고, 모르는 사람은 시간을 끈다는 걸 보여주는 거죠. 의외의 발견도 있었어요. 채점 결과를 주제별로 분석했더니 "실험 설계" 영역에서 학생들 점수가 유독 낮았는데, 이건 교수가 해당 주제를 충분히 다루지 못했다는 걸 객관적으로 보여준 거였어요. AI 시험관이 학생뿐 아니라 교수의 교수법 약점까지 진단해준 셈이죠.

물론 프로세스가 완벽하진 않았어요. 일부 학생들은 에이전트의 음성이 너무 위압적이라고 느꼈고, 에이전트가 여러 질문을 한 번에 엮어서 질문해서 질문 난이도가 너무 어려워지는 문제도 있었어요. "랜덤하게 케이스를 선택하라"고 프롬프트에 썼더니 특정 케이스만 계속 선택하는 문제도 발견됐고요. Ipeirotis 교수는 이 문제들을 파라미터 조정과 프롬프트 최적화로 해결할 수 있다고 말해요.

Ipeirotis 교수가 사용한 ElevenLabs 음성 에이전트 프롬프트와 채점 프롬프트는 아래 링크들에서 확인 가능해요

교수님이 만든 구술 시험 에이전트는 이 링크에서 실제 구술 시험 에이전트와 직접 대화할 수 있어요. 현재는 영어만 지원되고 있다는 점 참고해 주세요. 인증은 "My name is Konstantinos(콘스탄티노스) and my net id is kr888"이라고 하면 인증이 가능합니다. 음성이나 텍스트로 대화를 주고 받을 수 있어요. 인증이 통과되면, 아래 프로젝트에 대해 에이전트가 질문하게 될 거에요.

LinkedIn Recruiter, an agent that scans profiles and automatically sends personalized DMs to candidates on behalf of a recruiter. It engages in the first 3 turns of chat to answer basic questions (salary, location) before handing off to a human. (링크드인 리크루터 프로젝트: 후보자 프로필을 스캔해 리크루터를 대신해 개인화된 DM(다이렉트 메시지)을 자동으로 보내는 에이전트 프로젝트 입니다. 에이전트는 초기 3번의 대화 턴 동안 기본 질문(연봉, 근무 지역 등)에 답변하며 대화를 진행한 뒤, 이후에는 사람(리크루터)에게 인계합니다.)

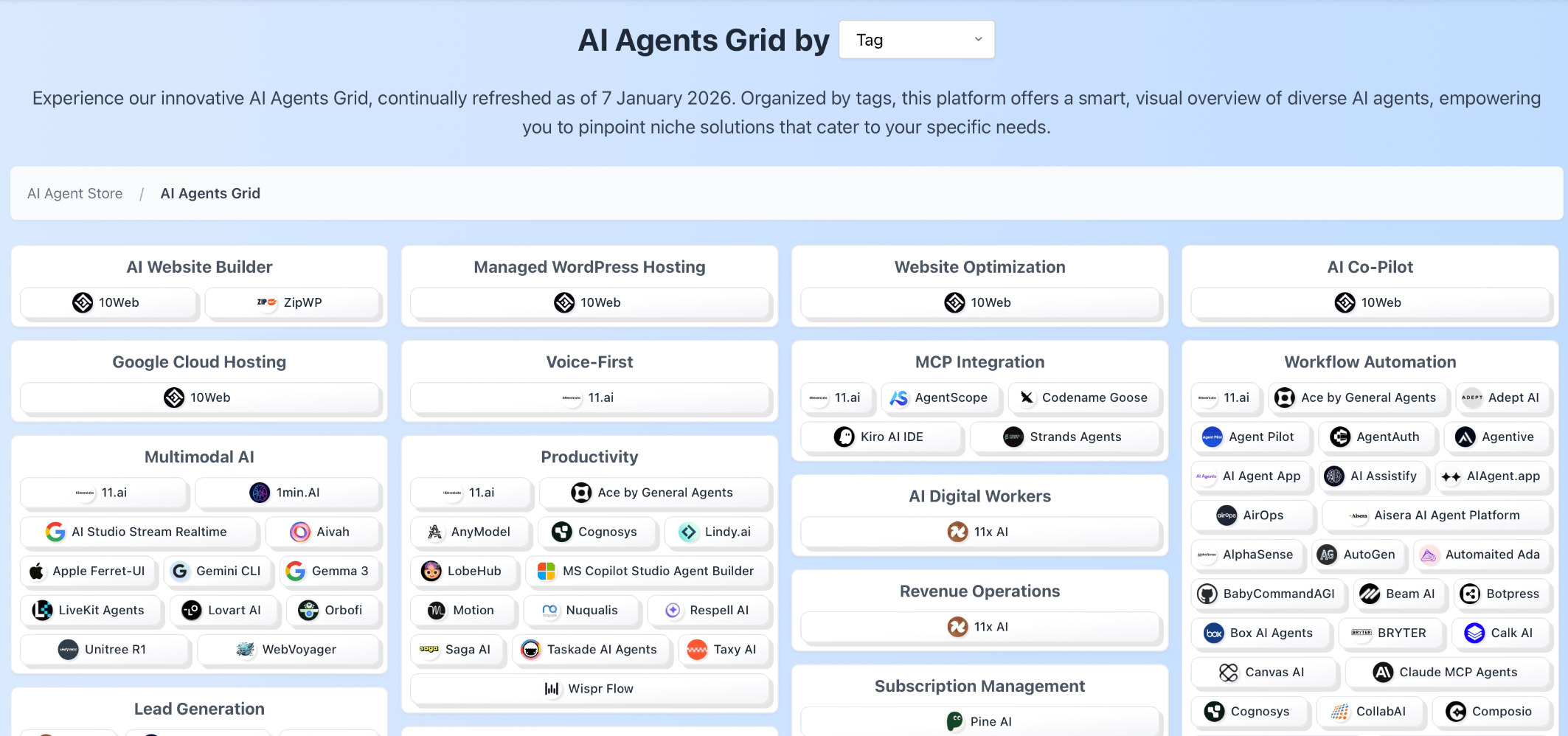

오토마타 스터디 카페 - AI Agent Landscape

오늘 가져온 사이트는 에이전트와 관련 모든 프로젝트를 한 곳에서 확인 가능한 플랫폼이에요. AI Agnet Store는 현재까지 개발된 대부분의 서비스들을 한 곳에 모아 둔 사이트에요. 에이전트를 만들 때 쓰는 메모리, 모델부터 에이전트를 활용해서 서비스를 하고 있는 플랫폼까지 모두 한 번에 확인이 가능해요. 각 서비스들은 아래 기준들로 나누어서 확인이 가능합니다!

- 카테고리 (AI 툴, 플랫폼, 프레임워크 등)

- 직업군 (개발자, 영상 제작자 등)

- 산업군 (HR, 디자인 등)

이 사이트를 보면서 다른 사람들이 어떻게 에이전트를 활용하고 있는지, 내 프로젝트에는 어떤 에이전트를 활용할 수 있는지, 그리고 에이전트 관련 시장 조사에 활용하기에도 유용해요!

의견을 남겨주세요