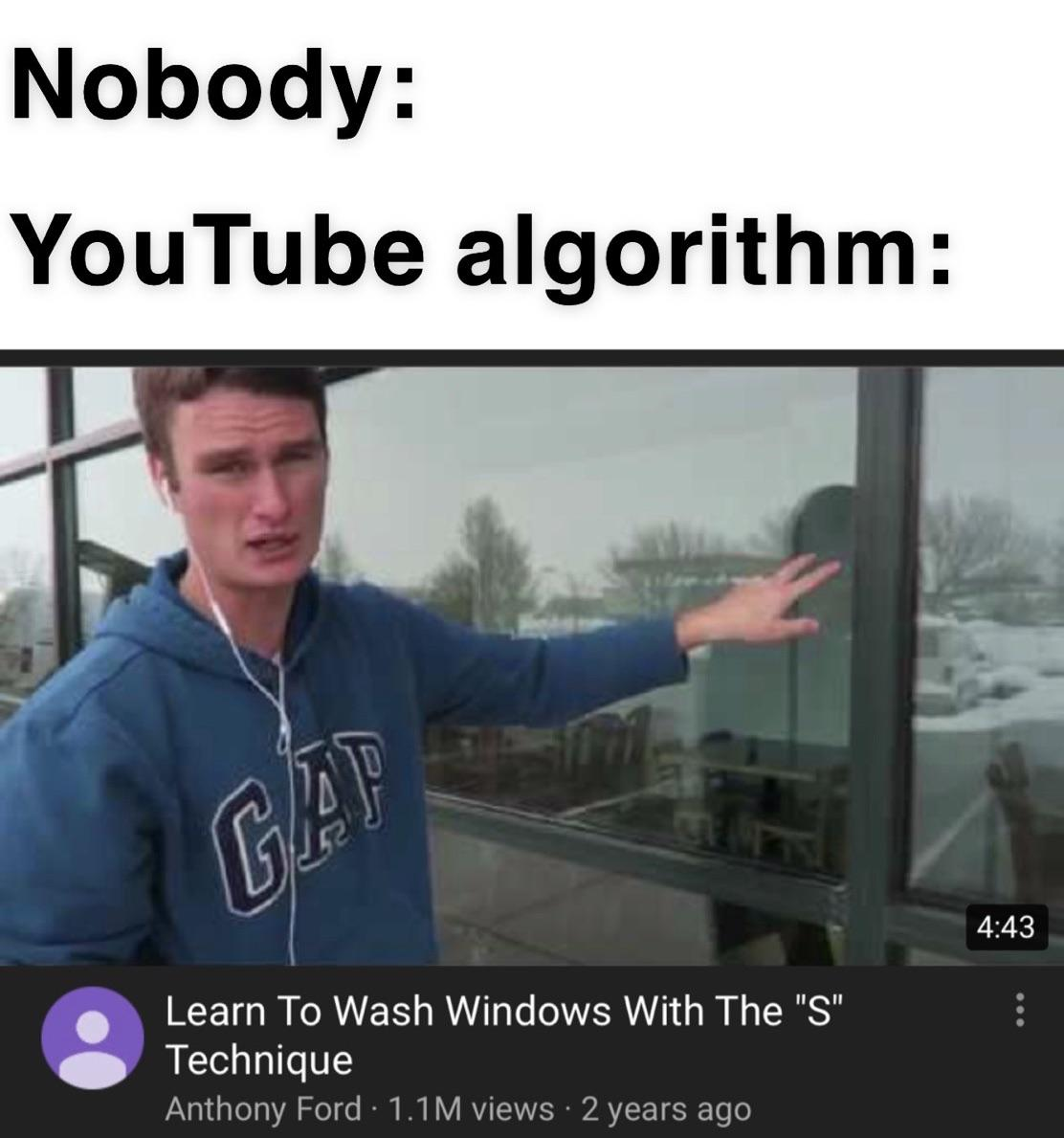

지난 주에 체스를 통해 볼 수 있는 알고리즘 문제들에 대해 알아봤어. 알고리즘과 관련된 다양한 문제들 중에, 한번 일상생활에서 들어볼 만한 알고리즘이 어떤게 있을까? 한번 생각해보다 이런 짤이 생각났어.

유튜브는 사람들을 유튜브에 오랫동안 머물게 해야하고, 즉 사용자가 동영상을 시청하는 총 시간을 늘려야해. 앞서 퀸스 갬빗에서 말했듯, 어떤 간결하고, 반복될 수 있는 시행으로 이루어진 규칙과 절차를 '알고리즘' 이라고 한다고 했잖아. 그럼 유튜브 사용자가 접속했을때 가장 오래 머물수 있는 방법을 푸는 문제에 대한 전략을 마련해 놓았을 것이고, 이런 규칙과 절차를 유튜브 알고리즘이라고 부를 수 있을 것 같아. 유튜브는 이 알고리즘을 6가지 메뉴,

유튜브 검색, 추천 동영상, 홈 화면, 인기, 구독 탭, 알림

에 만들어 놓았어. 주로 밈에서 쓰이는 '유튜브 알고리즘' 이라는 단어는 보통 추천 동영상과 관련된 알고리즘을 말해.

소위 짤, 밈에서 많이 쓰이는 Youtube recommendation, Youtube algorithm 의 실체는 어떤 것일까? 한번 알아볼까!?

협업 필터링

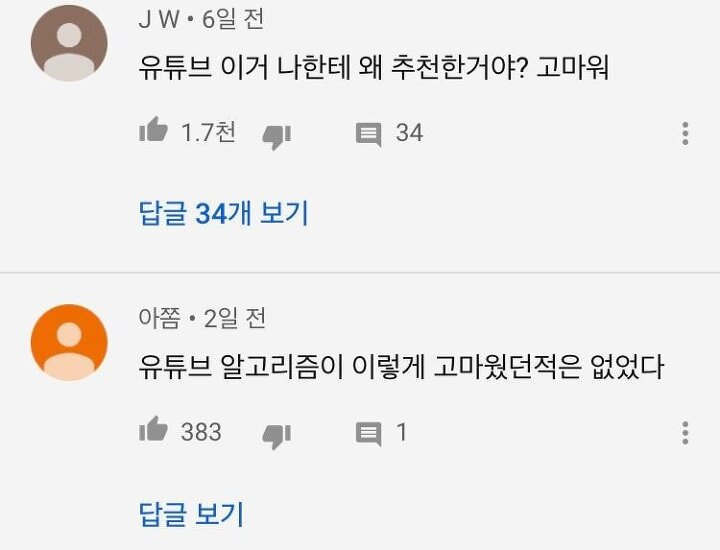

현재 나는 Audrey - Time (3:03) 이라는 노래를 들으며 글을 쓰는 중에, 오른쪽에 다음에 재생될 동영상으로 추천 동영상들이 떴거든. 대부분의 동영상들은 음악과 관련되어 있고, 한 가지 경우 '애정결핍 특' 이라고 하는 (...읭?) 동영상이 떴어. 클릭해보니 짧은 길이의 웹드라마 였어.

협업 필터링이란, 이용자들의 정보, 즉 나를 포함한 여러 이용자들이 재생한 동영상의 정보를 이용해서 필터링하여 추천해주는 방법이야. 여기서 이용자 여러명이라는 걸로 접근해보면, 왜 웹드라마가 나에게 추천되었을까 추측해 볼 수 있어.

추측 1) 나를 비롯한 다른 사용자들도 분석: 내가 보는 음악들을 보았을 때, 이들은 해당 웹드라마도 많이 보는 경향이 있었다.

추측 2) 나의 과거 이력 분석: 내가 이전에 보았던 음악들이 해당 웹드라마에서 사용되었다.

추측 1 과 같은 접근 방식을 이용자 기반 추천이라고 해. 취향이나 다른 정보 (GPS기반의 위치 정보, 나이, 성별, 인종 등) 을 이용하여 같은 그룹에 놓고, 이용자들에게 비슷한 동영상을 추천하는거야.

추측 2 와 같은 접근 방식을 아이템 기반 추천이라고 해. 예전에 보아온 동영상과 연관성이 높은 동영상을 추천하는 거야.

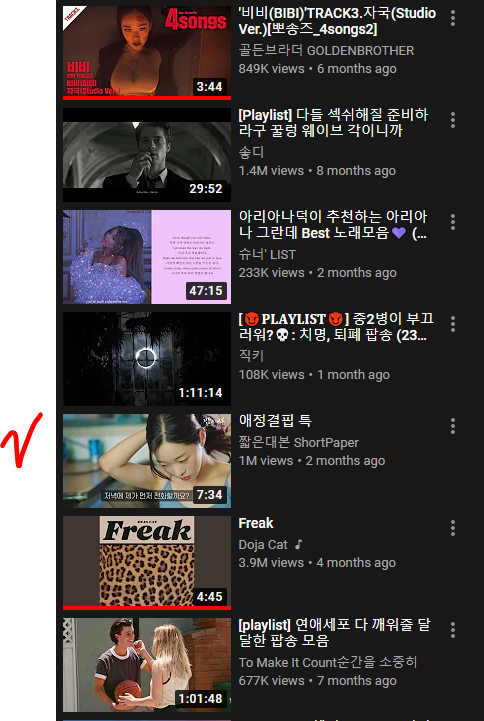

콘텐츠 기반 필터링

위의 협업 필터링의 경우, 사용자를 분석하여 동영상을 추천하는 형태였어. 콘텐츠 기반 필터링의 경우, 영상 자체를 분석하여 동영상을 추천하는 거야. 예를 들면, 내가 지금 영화 콜 2020 (15:48) 관련 영화 소개 영상을 보고 있었어. 이때 옆에 뜬 동영상들을 볼게.

협업 필터링의 경우, 사용자의 정보, 즉 영상 재생 히스토리를 알아야 하는데, 만약 사용자가 새로운 뉴비라면? 사용자의 연령이나 나이대 또한 알 수 없다면? 이와 같이 콘텐츠 자체를 분석하여 추천하는 알고리즘을 통해 협업 필터링을 보완할 수 있어. 영화를 소개하고, 그리고 그 영화가 스릴러 영화를 소개하는 동영상들을 추천할 수 있지. 아니면, 영화에 출연한 배우가 같은 영화를 소개할 수도 있고, 같은 제작사에서 만든 영화를 추천할 수도 있고.

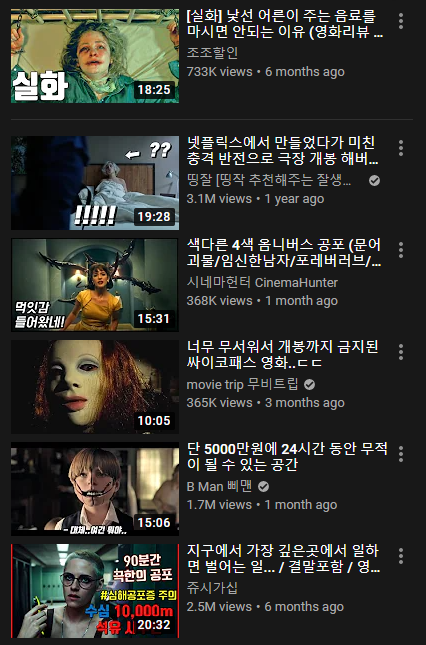

필터 버블

하지만 위에 말한 두 필터링 알고리즘을 통해 나에게 동영상이 추천된다면, 우리가 보아온 영상과 관련되고, 나와 비슷한 연령대가 보고, 그리고 보아온 것과 유사한 속성을 가진 영상들만 추천될 수 있어. 이와 같이, 추천 알고리즘을 통해 다양한 컨텐츠를 접하기 어려워지고, 취향이 편향 되어 어떤 막 안에 갇힌 것 같은 현상을 필터 버블 속에 갇힌다고 표현해.

예를 들면, 스릴러 영화를 주로 보는 사용자의 경우 추천하는 동영상으로 스릴러 영화만 주구장창 보게 되고, 앞으로 다양한 영화에 대한 추천을 받기 힘들어지지. 정치적인 영상을 자주 보는 사용자의 경우, 본인의 정치색에 맞는 영상을 보게 되고 이에 대한 추천 영상만 보게 되면, 반대 색깔의 영상은 접근하기 어려워져. 그럼 넷사세엔 본인 입맛에 맞는 것으로만 가득하게 되고, 본인의 가치관에 맞는 정보만 선택적으로 취득하게 돼. 이런 버블 속에 갖혀서 사는 세상, 물론 나의 취향에 맞춘 세상이라 편리하고 흥미로울 수 있지만, 과연 이게 올바른 세상일까?

정보의 다양성

필터 버블과 관련하여, 최근에 떠오른 이슈가 있어. 바로 구글의 인공지능 엔지니어가 팀닛 게브루가 쏘아올린 작은 공이야. 그는 AI 윤리팀에서 일하는 엔지니어이고, 구글에서 일하는 엔지니어들 중 많은 이들이 팀닛의 해고에 대해 부당하다는 의견을 밝히기도 했어. 이와 관련된 논쟁이 아주 뜨거운 감자야. 과연 그가 제출하고자 한 논문은 무슨 내용일까?

먼저 해당 사건을 간단히 요약해 본다면, 다음과 같아.

1. 팀닛 다른 연구진과 함께 구글의 대규모 언어 신경망 모델의 잠재적 위험을 지적하는 내부 보고서를 작성.

2. 이를 보고하려 하자, 윗선에서는 '논문 검토 2주 전이 아닌 마감일에 제출, 논문의 리뷰가 부족하다' 는 이유로 거부당함.

3. 논문의 피드백과 정식 승인절차를 충분히 받았다고 생각한 팀닛은 구글에 논문 철회 연구의 투명성, 윤리 AI팀과의 회의, 구글에서 받아들일 수 있는 연구의 변수들을 토의할 대화를 요구.

4. 위의 요구 사항이 구글에서 이뤄지지 않음.

5. 하다 못해 빡친 팀닛은 논문을 공개하지 못하게 하면 회사를 그만두겠다고 선언.

6. 그래 너 말대로 나가든가! 실제로 구글은 팀닛에게 해고를 통보함.

7. 이 이야기가 공개적으로 알려지면서, 다른 구글 연구원들이 본인의 논문은 어떻게 평가받고 외부에 공개되었는지 후기를 공유.

8. AI 윤리 분야에서 일하는 직원의 사임같은 해고에 부당함을 느낀 사람들의 분노(?).

그는 보고서에서 구글의 대규모 언어 신경망 모델의 여러 문제점들을 지적했는데, 이 중 하나는 과연 인공 지능이 사람의 차별적인 언어를 학습한다면 어떤 위험이 있겠는가? 에 관련된 내용이야. 차별적인 언어를 학습한 인공 지능으로 추천하는 동영상을 보고, 제품을 사고, 추천하는 음식점에 가고, 추천하는 옷을 입는다면 미래의 사람들은 과연 어떻게 행동하게 될까? 아까 들어본 필터 버블과 비슷한 맥락이지 않아?

예를 들면, 기업에서 사람을 채용한다고 했을 때, 기존에 이미 회사에서 일하고 있는 직원들의 배경으로 새로운 사람을 채용 한다고 하자. 이미 회사에 익숙한 배경의 사람들만 골라내게 되는 것과, 익숙한 배경의 사람들에 대한 데이터 베이스를 기반으로 새로운 분야의 사람들도 뽑아내는 것에 차이가 있어. 이와 관련된 내용을 팀닛은 보고서에서 주장했으며, 이는 AI 윤리팀 자체의 존재 목적이기도 해. 실제 논문의 질이 어땠는지, 그리고 구글의 해고 통보 절차가 합리적으로 이루어졌는지는 아직도 의견이 분분하지만, 이번 사건을 통해 사람들에게 AI 윤리에 대해 생각해 볼 거리를 줬다는 점이 시사하는 바가 크다고 생각해.

이번에는 최근에 화두가 된 사건과 함께 유튜브 알고리즘을 설명하면서, 이에 대한 부정적인 시각도 함께 다뤄 봤어. 관련된 피드백을 줄 수 있다면, 인스타그램 @the_toilet_papers 으로 DM을 줘! :)

의견을 남겨주세요