안녕하세요, 즐거운 월요일입니다.

오늘은 드디어 미뤄왔던 AI 윤리를 다뤄보려고 합니다.

AI 의 개발과 발전이 갑작스러운 것이 아니듯,

AI 가 야기할 수 있는 윤리적 문제와 규제에 대한 논의 역시 지속적으로 발전해왔습니다. 주로 'AI Ethic', 혹은 'Responsible AI' 라고 불려왔습니다.

특히 Responsible AI 는 Responsible investment + AI 로 보이는데, ESG 투자의 전신이면서 본체(?)인 책임투자(Responsible investment) 라는 단어에 익숙하지 않다면 정체불명의 신조어처럼 보일 수도 있겠습니다.

해외에서 자료와 이니셔티브 결성 등을 통해 Responsible AI 에 대한 논의가 활발해졌다고 느낀 것은 작년 하반기부터였습니다.

생성AI와 ChatGPT 가 화제가 되기 시작한게 올해 초인데 그보다 더 빠르게 윤리적 논의가 본격화되었다고 볼 수 있습니다. EU의 AI 규제 역시도 최근 국내에는 소개되었지만 이미 초안 작성 및 많은 논의가 진행되어 있는 상황입니다.

2022년 9월에 작성된 이 글에서는, 글로벌 규제 현황을 정리하고 Responsible AI 도입을 위해 AI 감사(Auditing) 의 필요성을 제시합니다.

EU 규제 초안에 대해서도 상세히 제시되어 있습니다.

AI Liability Directive

https://www.europarl.europa.eu/RegData/etudes/BRIE/2023/739342/EPRS_BRI(2023)739342_EN.pdf

EU AI Act

https://www.holisticai.com/blog/eu-ai-act

한편, 위 글을 쓰기도 했고, VentureESG 와 함께 Responsible AI 관련 연구, 지필 등의 활동을 하는 분이 있는데, Ravit Dotna 박사입니다. 이분이 지속적으로 AI 윤리 연구를 해오고 있는데, 오늘은 그 중에서도 'Responsible Investing in AI Guide'를 살펴보려고 합니다.

먼저 AI 에 대해 책임투자를 왜 해야하는지에 대해서 이야기합니다.

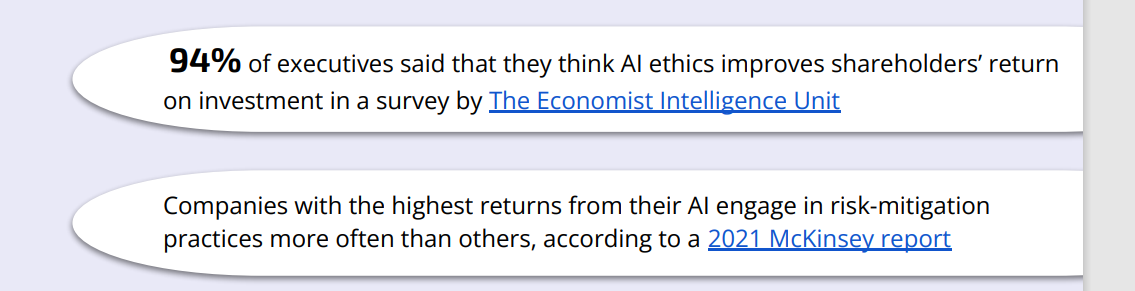

멋진 점은 수익률로 이야기한다는 부분입니다.

AI 책임투자가 수익률에 긍정적이라는 두 가지 연구결과를 보여줍니다. 그리고 그 원인으로는 1) 컴플라이언스, 2) 제품의 질, 3) 제품 수용, 4) 인재확보, 5) 레퓨테이션을 제시하고 있습니다.

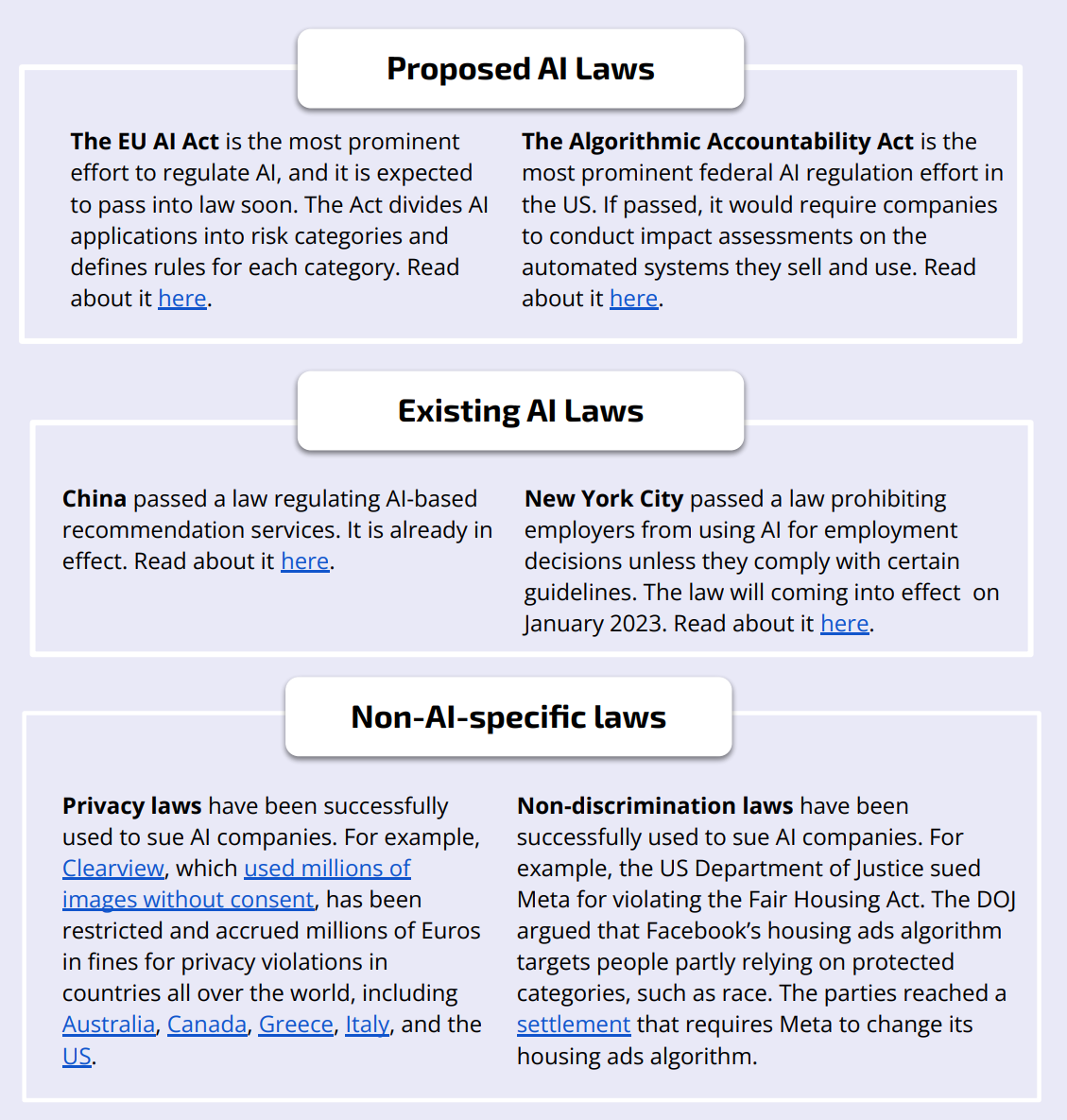

특히 컴플라이언스는 관련 법적 규제에 대한 이야기입니다.

이부분도, 현재 적용되고 있는 법규, 제안 중인 법규, 그리고 AI 를 겨냥한 것은 아니지만, 다른 Tech 회사들에게도 중요하게 적용되고 있는 법안을 제시해줍니다.

그리고는 바로 어떻게 책임있는 AI 투자 관점에서 실사를 진행할 것인지에 대해 상세하게 논의하기 시작합니다.

아... 책 제목 맨 끝에 for VC 라는 말이 있었죠..

아무리 그래도 갑자기 실사로 들어가다니 VC 투자에 대한 이해가 없으면 보지 말라는건가요 ㅎㅎㅎ

약간의 배경설명을 드리자면,

사모펀드/VC 들이 책임투자(ESG투자)를 실시하는 가장 강력한 방법, 그리고 가장 많이 이용되는 방법은 바로 '실사 due diligence' 입니다.

ESG 정책은 이제 대부분 있으시고.. 투자심의에 ESG 를 고려하는건 아직 어렵고..

ESG 실사 정도가 ESG투자를 하느냐의 기로인데,

아시다시피 실사가 돈이 많이 듭니다.. 그래서 어떻게든 체크리스트 형태로 간략하게 만들어서 심사역들이 직접 수행하는게 현재 상황이라고 하겠습니다..

(그러다보니 바로 지난번에 말씀드린 것처럼, 인권실사를 해야한다는 이야기까지 나오면 상당히 곤란해지고 상세한 가이드가 필요해집니다..)

그래서 실사에 들어갑니다.

여기서부터는 매우 실무적인 내용입니다. 당연히..

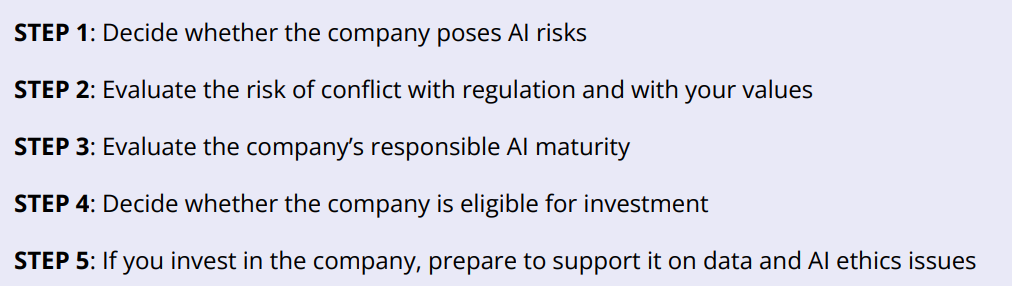

다음과 같은 다섯 단계를 제시하죠.

1단계. AI 위험이 있는지 없는지 본다.

2단계: 그 위험이 규제 혹은 투자자의 가치와 상충되는 부분이 있는지 평가한다.

3단계: 투자하고자 하는 회사가 책임AI 를 갖추고 있는지 평가한다.

4단계: 투자할지말지 판단한다.

5단계: 만약에 투자했다면, AI윤리 관련해서 열심히 돕는다!

실사라더니.. 4-5 단계는 투자결정 및 관여(Engagement) 영역이네요 ㅎㅎ

그냥 좀 쉽게 이야기한다고 이해해주시고 한단계씩 보도록 하겠습니다.

1단계: AI 위험이 있는지 없는지 본다.

AI 위험이 있는 회사로 3가지 유형을 제시합니다. AI 개발사, AI 이용사, 대량의 데이터를 처리하는 기업.

이 3가지 유형 중 하나에 속하는 회사라면 2단계로 넘어갑니다.

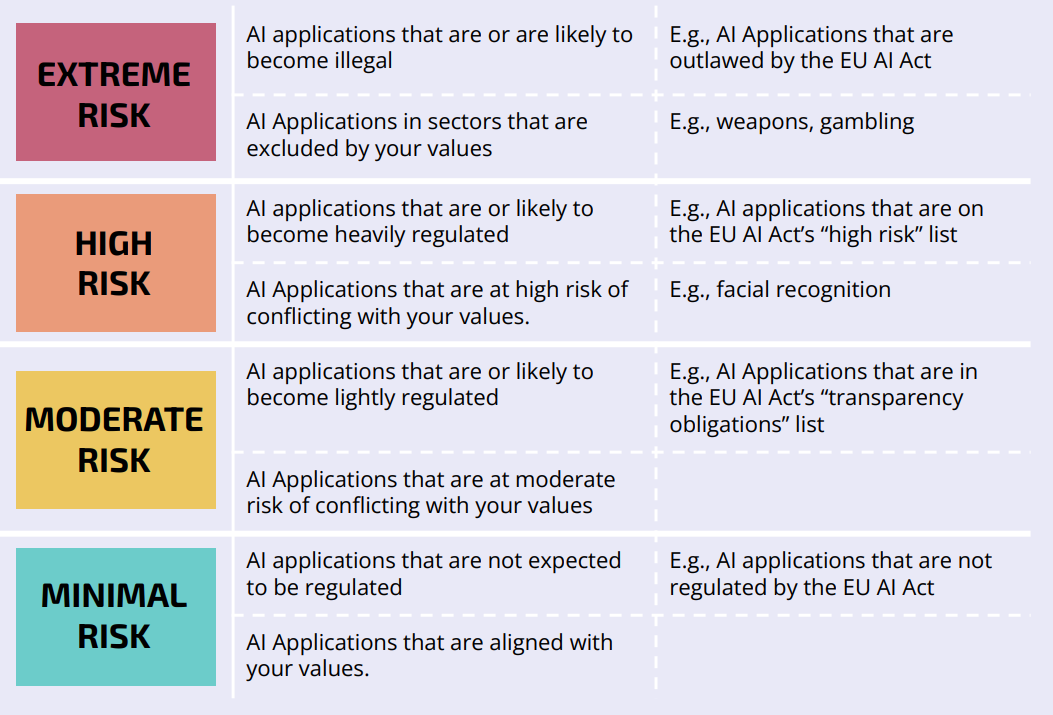

2단계: 위험이 규제 혹은 투자자의 가치와 상충되는 부분이 있는지 평가한다.

위험을 다음의 4단계로 나누기를 제안합니다. Extreme-High-Moderate-Minimal .. 사실 이건 하나마나한 이야기이지만.. 왜 이렇게 당연한걸 나눠놨는지는 이해가 갑니다. 그래야 표준화가 가능해서.. 시장 참가자들이 명확하게 보고 싶어하기를 바라는 점도 있고요.

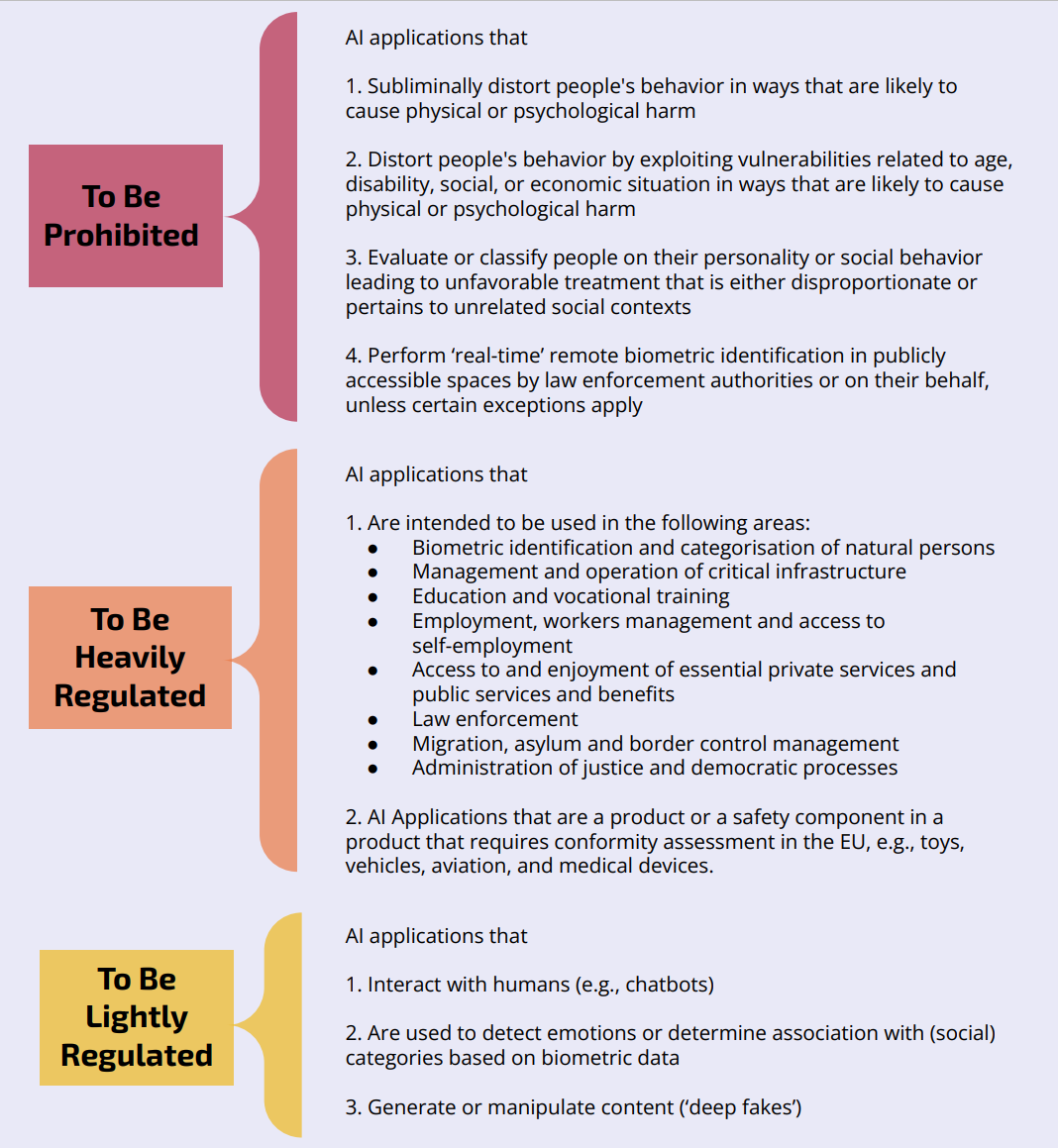

특히 EU 의 법규가 상당히 가시화되어 있기 때문에 이를 참고하기를 권하면서 EU AI Act 에서 분류할 규제 대상에 대해 정리해줍니다.

3단계: 투자하고자 하는 회사가 책임AI 를 갖추고 있는지 평가한다.

3가지 관점에서 평가합니다. (1) 관련 지식을 가지고 있는지 (Knwledge), (2) 구체적으로 하고 있는 일이 있는지 (Workflow) (3) 보고(Reporting) 및 감시(Auditing)를 받고 있는지 (Oversight)

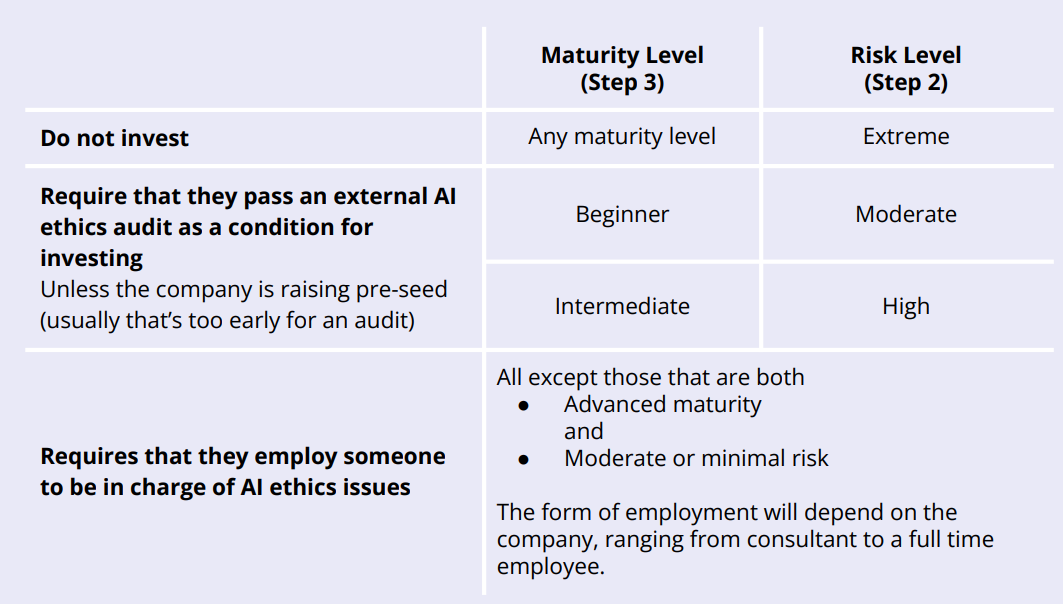

4단계: 투자할지말지 판단한다.

2단계와 3단계를 종합적으로 보고 판단합니다.

Step 3 가 있다고 Step 2 를 다 보장할 수는 없겠지만..

이렇게 논리적인 틀을 만들어 놓는게 저희의 최선ㅠ 이겠습니다. 만일의 사태에 더 잘 대비할 수도 있고요.

5단계: 만약에 투자했다면, AI윤리 관련해서 열심히 돕는다!

평가나 교육 등을 통해 여러가지 기여하는 방법을 제시합니다.

참 쉽죠잉~

이다음은 Case Study 가 나오는데 이것도 재밌습니다.

Case Study 를 보면 더 이런 생각이 들지만..

결국은 회사에 대해서 완벽하게 이해를 하자는 것이 책임투자, ESG 투자의 핵심 중 하나라고 생각합니다.

규제에 대해 좀 더 자세히 알고 싶으신 분들은 EU AI Act 를 한번 보시길 권합니다.

내용이 빠진 구조에 대한 이야기라서 도움이 되실지 모르겠네요.

즐거운 일주일 되시길 바랍니다.

의견을 남겨주세요