2024년, AI라는 거대한 파도가 우리 일상을 휩쓸고 있습니다. 이 파도에 휩쓸리지 않고 오히려 멋지게 AI라는 파도를 타는 법을 함께 배워보면 어떨까요?

'해달리'는 바로 그 방법을 찾아 여러분과 공유하고자 탄생했습니다.

AI 시대를 살아가는 우리들의 이야기, 그리고 AI를 적극적으로 활용하며 새로운 길을 개척해나가는 분들의 인사이트를 해달리가 전해드릴게요.

우리의 일상에 스며든 AI 기술

얼마 전 청력이 나빠지신 어머니와 함께 보청기를 사러 갔습니다. 큰 기대 없이 찾은 보청기 전문점에서 저는 놀랄 수밖에 없었습니다. 우리가 흔히 알던 단순한 보청기가 아니였기 때문입니다.

보청기는 이제 AI 기술이 집약된 첨단 장치로 변해 있었습니다.

각종 AI기능이 더해진 그 보청기는 단순히 주변의 소리를 크게 증폭해주는 기계가 아니라, 주변 소리를 선별해서 소음을 줄여주고, 스마트폰과 연결되어 통역도 해주고, 이어폰처럼 핸드폰의 음악을 듣거나 하는 등, 사용자를 다방면으로 도와주는 복합적인 AI 장치로 발전해 있었습니다.

(어머니는 보청기의 모든 기능을 사용하고 계시지는 않지만, 주변의 소음을 알아서 줄여주는 기능에 매우 흡족해 하셨습니다.)

저는 그 밖에도 어떤 방식으로 AI가 사람들의 불편함을 해결하고 있을지 궁금해 졌습니다.

잃어버린 시각, 청각, 음성이 되어 사람들의 소통을 돕는 AI 기술들

오늘은 특히 시각과 청각의 어려움으로 불편을 겪는 분들, 그리고 발음이나 목소리의 문제로 의사소통에 어려움을 겪는 분들을 돕는 AI 기술들의 다양한 사례를 알아보려고 합니다.

시각

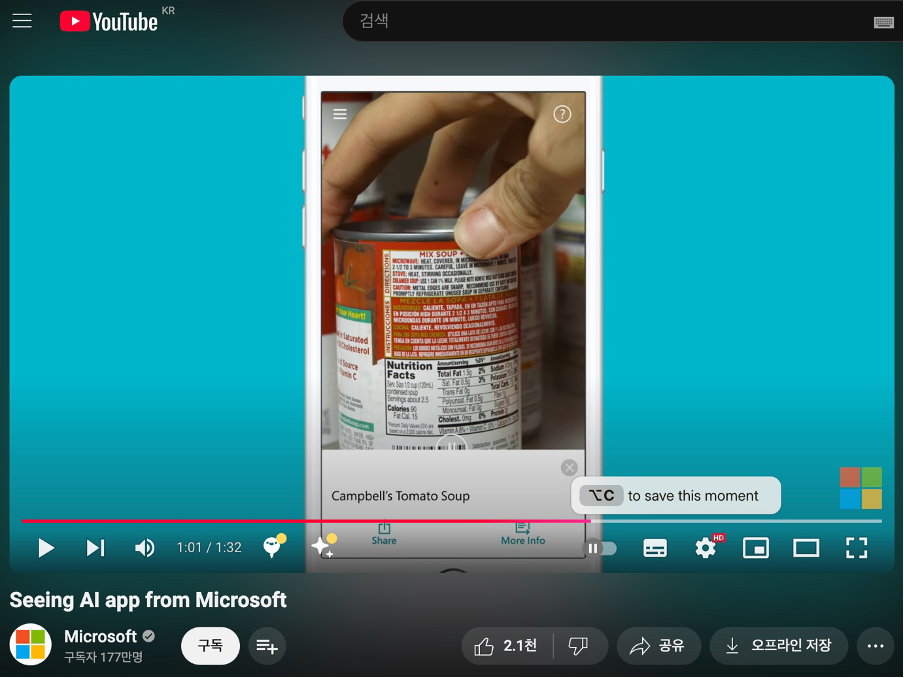

1. Microsoft Seeing AI:

이 앱은 사용자의 스마트폰 카메라를 이용하여 주변 환경을 인식하고, 그것을 음성으로 설명해줍니다.

예를 들어, 길거리에 있는 표지판을 읽어주고, 사람의 얼굴을 인식해 누가 있는지 알려주거나 제품을 찍으면 어떤 제품인지 알려주는 기능들을 통해 시각장애인들이 일상생활에서 더 많은 독립성을 가질 수 있게 해줍니다.

Seeing AI는 처음 Microsoft의 해커톤에서 시작된 작은 프로젝트였지만, 2017년에 공식 출시된 이후 지속적인 발전을 거듭하며 사용자들에게 더 큰 도움을 주고 있습니다.

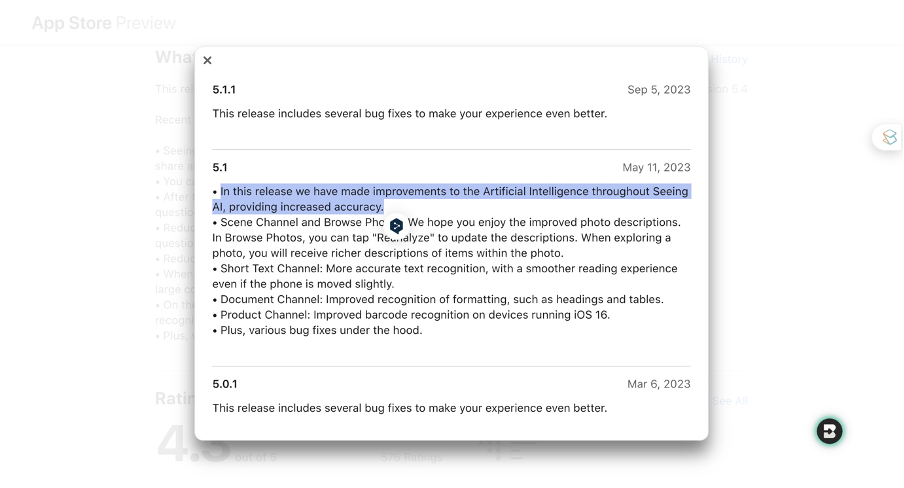

특히, 2023년부터 5월부터는 AI, LLM(대형 언어 모델)을 활용, 서비스를 개선하여 사람의 말이나 문장을 더 잘 이해하고 주변 사물을 더 정확하게 인식하게 되었습니다.

출처: https://www.microsoft.com/en-us/garage/wall-of-fame/seeing-ai/

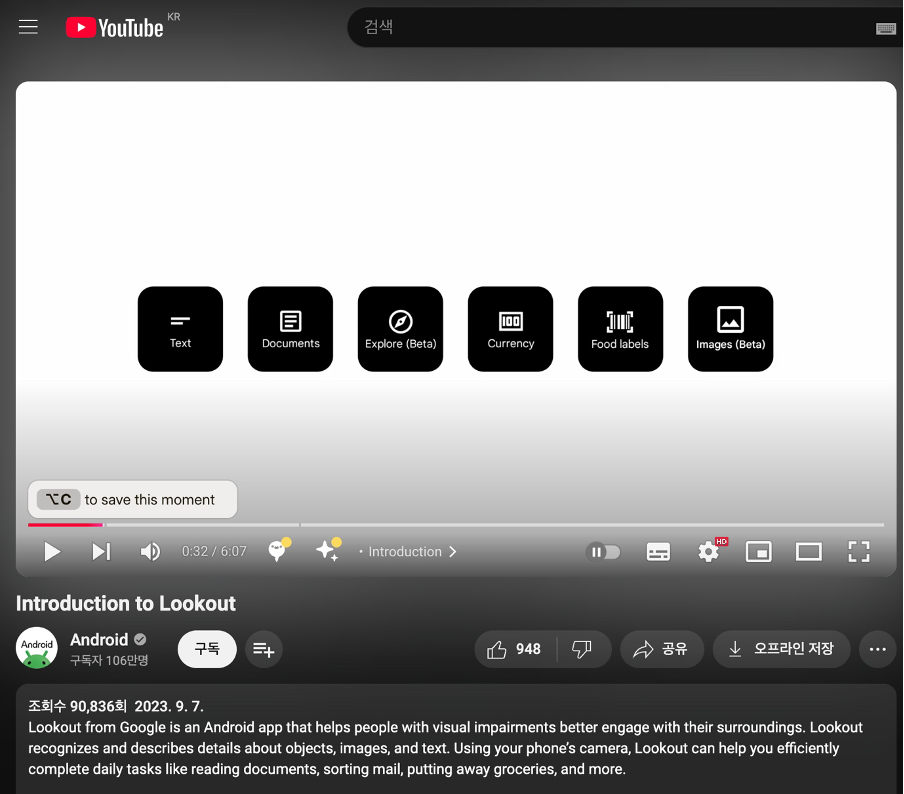

2. Google Lookout:

Lookout은 시각장애인이나 저시력자들이 주변의 물체를 더 잘 이해할 수 있도록 돕는 앱입니다. Microsoft Seeing AI와 비슷한 기능을 가지고 있으며, 시각적 정보를 음성으로 설명해 주는 서비스를 제공합니다. 예를 들어, 우편물 분류에서 레시피 확인, 동네 산책에 이르기까지 다양한 작업을 도와줍니다.

구글은 시각장애인이나 저시력자들이 생활 업무를 더 쉽게 수행할 수 있도록 돕기 위해 2018년에 Lookout을 출시했습니다. 그리고 최근에는 한국어를 포함한 11개 언어로 언어지원이 확대 되었습니다.

출처: https://blog.google/intl/ko-kr/company-news/outreach-initiatives/lookout-korean-kr/

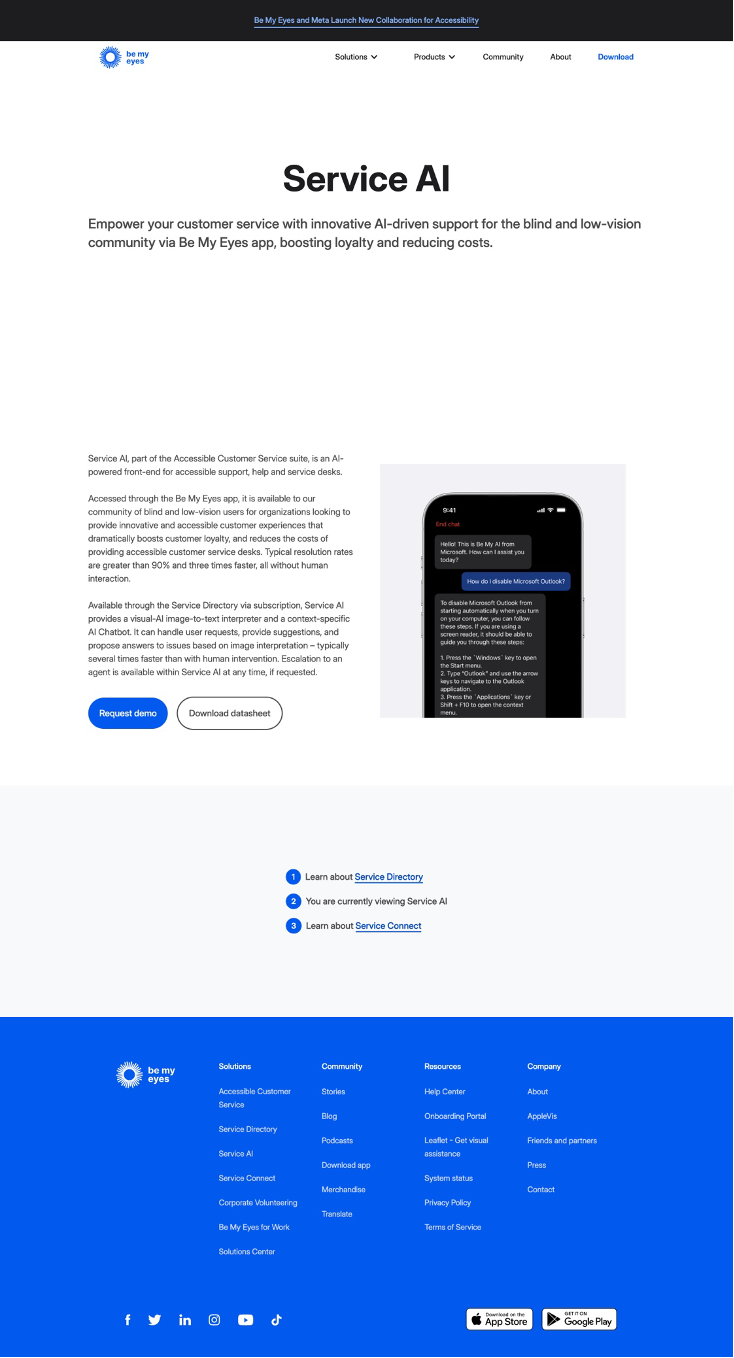

3. Be My Eyes:

Be My Eyes는 시각장애인과 자원봉사자를 실시간으로 연결하여 일상적인 문제를 해결하도록 돕는 서비스로 시작 했습니다. 사용자가 앱을 통해 도움을 요청하면, 여러 자원봉사자에게 알림이 전송되고, 그 중에서 가장 먼저 응답한 자원봉사자와 연결되어 시각적 정보를 제공합니다.

예를 들어, 사용자는 자원봉사자에게 유통기한 확인, 색상 구분, 물체 식별 등의 도움을 요청하고, 답변을 받을 수 있습니다.

AI기술 도입: 최근에는 여기에 AI 기술이 도입되어 'Be My AI' 기능이 추가되었습니다.

이 기능은 OpenAI의 GPT-4를 활용하여 사용자가 이미지를 전송하면 AI가 상세한 설명을 제공하고 추가적인 질문에도 응답합니다. 이를 통해 사용자는 자원봉사자의 응답을 기다릴 필요 없이, 즉각적인 시각적 정보를 얻을 수 있게 되었습니다.

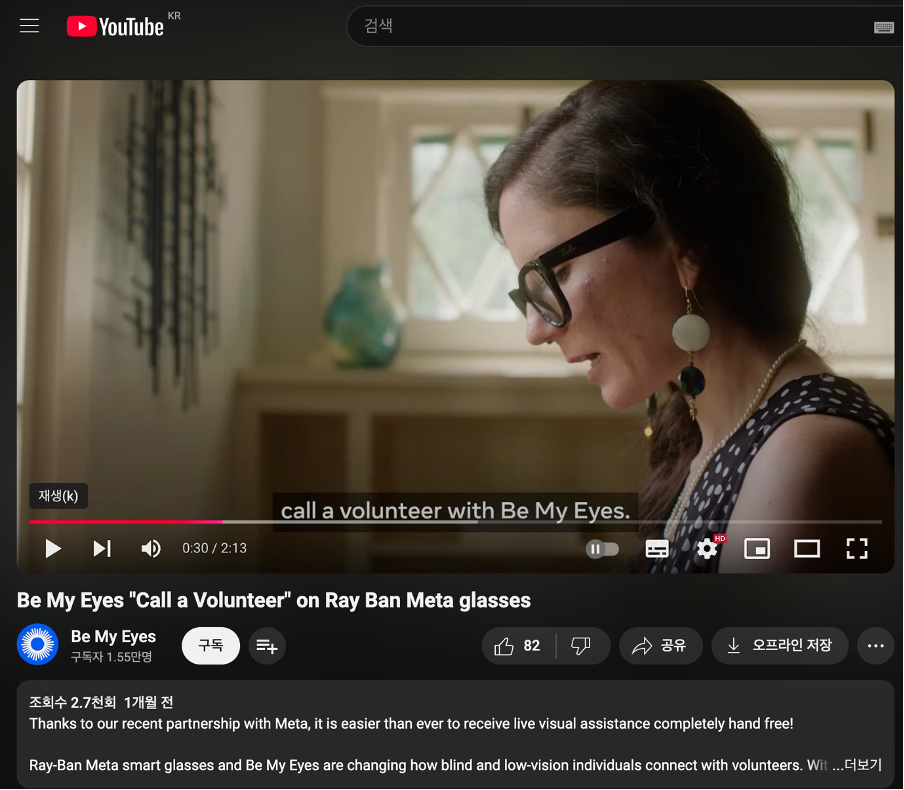

스마트 안경과의 통합: 또한 최근에는 Meta와의 협업으로 Ray-Ban Meta 스마트 안경에 "Call a Volunteer" 기능이 도입되었습니다. 사용자는 핸드폰이 아니라 스마트 안경을 통해 자원봉사자와 실시간으로 연결되어 슈퍼마켓에서 물건을 찾거나 복잡한 길을 안내받는 등 다양한 도움을 받을 수 있습니다.

Be My Eyes는 기존의 자원봉사 기반 서비스에 더해, chat GPT, 그리고 스마트 안경을 도입하며 시각장애인을 돕는 방식에 계속해서 혁신을 가져오고 있습니다.

출처: https://www.bemyeyes.com/blog/be-my-eyes-meta-accessibility-partnership

위 유튜브 영상은 Be my Eyes의 AI 서비스를 이용하는 영상입니다. Andy는 핸드폰을 이용해서 자신의 앞에 어떤 풍경이 보이는지 AI에게 물어보고 그 답을 얻습니다.

청각

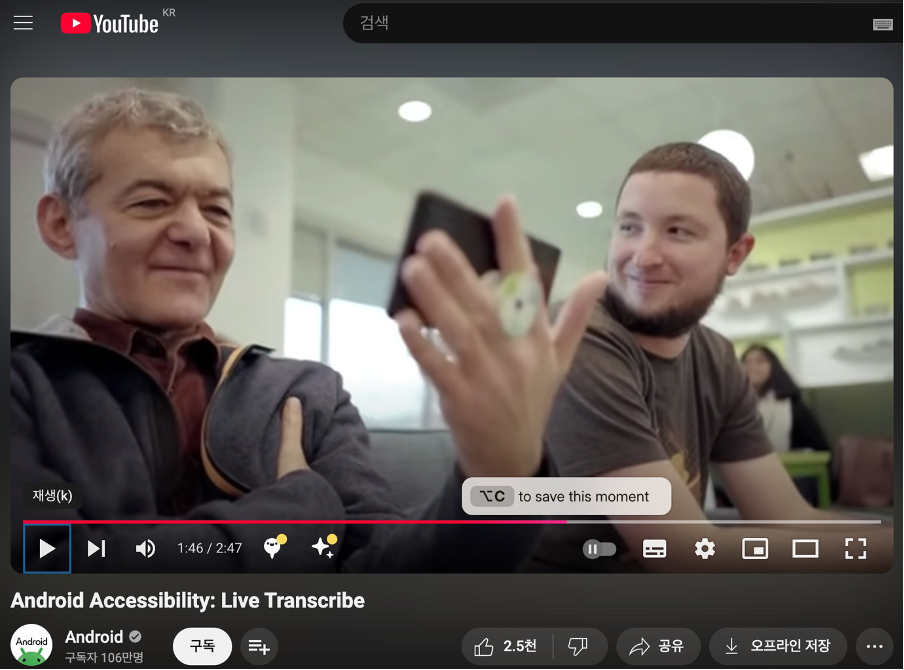

Google Live Transcribe:

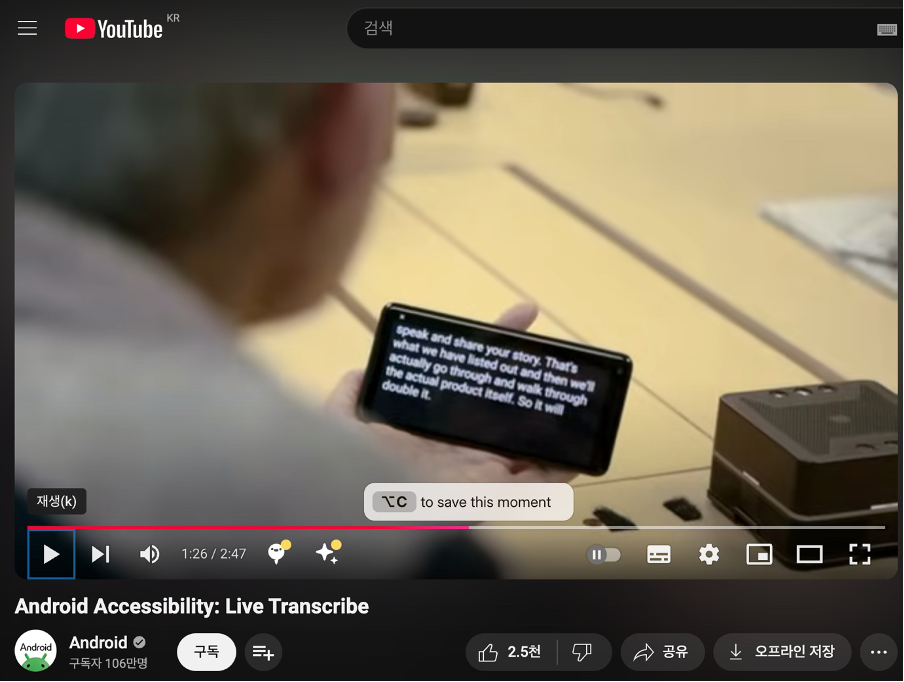

이 앱은 청각장애인들을 위해 실시간으로 음성을 텍스트로 변환해주는 기능을 제공합니다.

대화 중 상대방의 말을 텍스트로 즉시 보여주기 때문에 청각적인 어려움을 겪는 사람들도 대화에 쉽게 참여할 수 있습니다. 특히 소음이 많은 환경에서도 높은 정확도를 자랑하며, 70개 이상의 언어를 지원하고 있어 글로벌 사용자들에게 유용합니다.

Live Transcribe는 청각 장애인들에게 다음과 같은 도움을 줄 수 있습니다.

1. 대화나 강의를 이해하는 데 도움을 줍니다.

2. 청각 장애인끼리 의사소통을 하는 데 도움을 줍니다.

3. 청각 장애인이 타인과 소통할 때 자신감을 높여줍니다.

4. 뿐만 아니라, Live Transcribe는 외국어를 배우는 사람들에게도 유용합니다.

https://www.android.com/accessibility/live-transcribe/

목소리

Voiceitt:

Voiceitt는 AI 기반 음성 인식 플랫폼으로, 발음이 독특하거나 부정확한 사용자들이 명확하고 독립적으로 의사소통할 수 있도록 지원합니다.

Voiceitt는 사용자의 고유한 발음 패턴을 학습하여, 음성 명령을 정확하게 인식하고 이를 텍스트나 음성으로 변환하여 출력합니다. 이를 통해 사용자들은 스마트 홈 기기 제어, 문서 작성, 일상 대화 등 다양한 활동을 보다 원활하게 수행할 수 있습니다.

(출처: [https://www.voiceitt.com](https://www.voiceitt.com))

AI와 함께하는 더 나은 내일

오늘 소개해 드린 이야기는 기술이 사람들의 삶을 어떻게 더 나아지게 만들 수 있는지 보여주는 작은 사례들일 뿐입니다. 우리는 AI가 신체적 불편을 겪는 분들에게 얼마나 중요한 역할을 하고 있는지, 그리고 그것이 그들의 일상을 얼마나 편리하게 변화시키는지를 함께 살펴보았습니다.

AI 기술은 시행착오를 거듭하며 발전합니다. 여기서 중요한 것은 그 "방향성"이라고 생각합니다. 결국 누가 어떤 방식으로 활용하느냐에 따라 그 가치가 달라지기 때문입니다.

사람을 위한 AI, 즉 삶을 개선하고 불편함을 해소하는 기술을 계속해서 발전시켜 나간다면, 앞으로도 AI는 더 많은 사람들에게 새로운 기회를 제공하고, 일상의 어려움을 해결하는 데 기여할 것입니다.

다음 뉴스레터에서는 더욱 풍부한 이야기로 여러분의 일상에 영감을 드릴 수 있도록 찾아 뵙겠습니다.

더 재미있는 이야기를 보고 싶다면 아래 해달리 리틀리를 방문해보세요!

의견을 남겨주세요

Jay Kim

사람들에게 도움이 되는 기술들에 대해 글을 쓰고 나니까 계속해서 관련 기술들에 대한 글과 영상이 눈에 들어옵니다. https://www.threads.net/@aicoffeechat/post/DDO9qSXAK7q?xmt=AQGz20mrYWK_IxMC451jadWrjf_FD8g7Laz-V7nijAwWNQ 사람의 발처럼 지면에 적응하도록 만들어진 무동력 의족에 대한 내용을 공유합니다.

의견을 남겨주세요