초록

생성형 AI(GenAI)는 영화 제작 분야에 혁신을 가져오고 있습니다. GenAI는 텍스트-이미지 변환, 이미지-비디오 변환(디퓨전 모델 기반), 뉴럴 래디언스 필드(Neural Radiance Fields), 아바타 생성, 3D 합성 등 다양한 툴을 아티스트들에게 제공합니다.

본 논문에서는 이러한 기술이 영화 제작 현장에서 어떻게 활용되는지 살펴봅니다. 또한, 최근 AI 기반 영화들의 제작 과정을 분석하여 GenAI가 캐릭터 구현, 시각적 스타일 형성, 그리고 이야기 구성에 어떻게 기여하는지 알아봅니다.

우리는 캐릭터의 일관성을 유지하고, 작품 전체의 스타일을 통일하며, 움직임의 연속성을 확보하기 위한 주요 방법론들을 탐구합니다. 또한 3D 콘텐츠 생성 기술의 활용 증가와 실사 영상에 AI 생성 요소를 통합하는 최신 동향 역시 주목합니다.

기술적인 발전을 넘어, GenAI가 어떻게 새로운 예술적 표현을 가능하게 하는지도 탐구합니다. 여기에는 촬영이 어려운 장면의 생성, 몽환적인 디퓨전 기반 모핑 효과, 추상적인 시각 이미지, 초현실적인 오브제 구현 등이 포함됩니다.

더 나아가, 아티스트들이 겪는 어려움과 개선 요구사항에 대한 의견을 수집했습니다. 특히 일관성 확보, 제어 가능성 증대, 세밀한 편집 기능, 움직임 표현 개선 등에 대한 목소리에 귀 기울였습니다.

본 연구는 AI와 영화 제작이 만나는 지점의 현재와 미래에 대한 통찰을 제공하고자 합니다. 이를 통해 빠르게 발전하는 이 분야를 연구하는 연구자들과 현장의 아티스트 모두에게 유용한 길잡이가 되기를 기대합니다.

1. 서론

최근 몇 년간 생성형 AI(GenAI) 기술은 눈부신 발전을 이루었습니다. 특히 디퓨전 모델(diffusion models), 가우시안 스플래팅(Gaussian Splatting) 및 뉴럴 래디언스 필드(NeRF) 기반 모델을 활용한 3D 에셋 제작, 아바타 합성 등의 분야에서 큰 진전이 있었습니다. 이처럼 AI 기반 콘텐츠 제작 기술이 고도화되면서, AI를 활용한 영화 제작 또한 현실화되고 있습니다. 실제로 지난 몇 년간 AI로 제작된 영화의 수가 꾸준히 증가하는 추세입니다.

하지만 현재 예술계와 학계 사이에는 여전히 간극이 존재합니다. 예를 들어, 아티스트들은 GenAI 기술의 어떤 부분에서 예측 불가능성이 발생하는지, 왜 캐릭터의 일관성을 유지하기 어려운지, 또는 하나의 프레임 안에 여러 캐릭터를 묘사하는 지시가 왜 혼란을 야기하는지 등에 대해 기술적 이해가 부족한 경우가 많습니다.

반면, 연구자들은 실제 영화 제작 현장에서 요구되는 효과적인 작업 방식이나 창의적인 필요에 대해 충분히 알지 못하는 경향이 있습니다. 가령 아티스트들에게 정말 1분 길이의 생성 영상 클립이 필요한지, 캐릭터와 카메라 움직임은 어느 수준까지 제어 가능해야 하는지와 같은 구체적인 요구사항을 파악하기 어렵습니다.

이러한 배경에서 본 논문은 MIT AI 영화 해커톤의 데이터를 분석합니다. 이 해커톤은 3년간(2023, 2024, 2025) 수백 편의 AI 영화가 출품된 행사로, 참가자들을 대상으로 한 설문 조사를 통해 귀중한 자료를 수집했습니다. 해커톤 출품작 데이터를 바탕으로 다양한 GenAI 툴들이 현장에서 얼마나 활용되고 있는지(채택률)를 조사했습니다.

또한 아티스트들의 주요 관심사와 기대치를 정량적으로 분석했습니다. 더불어, 창작 과정에서 GenAI 툴을 효과적으로 사용하는 실제 사례 연구를 통해 구체적인 활용법을 제시합니다. 궁극적으로 본 연구는 AI 영화 제작 환경 전반을 조망하고, 현재의 주요 동향, 모범 사례, 그리고 앞으로 해결해야 할 과제들에 대한 깊이 있는 통찰을 제공하는 것을 목표로 합니다.

2. 관련 연구

2.1 영화 제작 과정의 이해

전통적인 영화 제작 과정은 크게 세 단계로 나뉩니다. 첫째는 각본 작성, 스토리보드 제작, 캐릭터 디자인 등을 포함하는 사전 제작 단계입니다. 둘째는 연출, 촬영 및 여러 부서 간의 협업이 이루어지는 제작 단계입니다. 마지막은 편집, 특수 효과, 사운드 디자인, 믹싱 등을 진행하는 후반 작업 단계입니다.

멀티모달 AI 기술이 발전하면서, 연구자들은 텍스트 입력만으로도 일관성 있는 영상 클립이나 완전한 AI 기반 단편 영화를 생성하는 모델을 개발하고 있습니다. 이러한 텍스트-비디오 모델은 등장인물의 외형과 움직임까지 종합적으로 만들어냅니다. 최근 개발된 일부 멀티모달 생성 모델 파이프라인은 까다로운 장면 전환 속에서도 영상 내부의 연속성, 스타일의 일관성, 그리고 캐릭터 간의 자연스러운 상호작용을 유지하는 성능을 보여주고 있습니다.

AI 기술은 2D 프레임 생성을 넘어 3D 및 4D 에셋 제작으로 영역을 넓히고 있습니다. 가상 배우 제작 등에 뉴럴 래디언스 필드(너프, NeRF), 3D 가우시안 스플래팅(Gaussian Splatting), 동적 3D 표현(dynamic 3D representations)과 같은 모델들이 통합되면서, 사실적인 장면 합성과 시간적 일관성 확보가 가능해지고 있습니다. 이러한 접근법을 통해 영화 제작자들은 시간의 흐름에 따라 객체와 배경 환경을 생성하고 움직임을 부여할 수 있으며, 이를 통해 공간과 스타일에 대한 높은 충실도를 확보할 수 있습니다.

AI 기반의 아바타 생성 및 인간 동작 합성 기술 또한 중요한 발전 분야입니다. 이 기술들은 뉴럴 지오메트리(neural geometry)와 동작 사전 지식(motion priors) 등을 활용하여 디지털 캐릭터를 만듭니다. 이렇게 생성된 전신 아바타는 표현력이 풍부한 얼굴 표정과 물리적으로 자연스러운 움직임을 갖추게 됩니다.

이러한 가상 배우들은 고해상도 텍스처와 골격 리깅(skeletal rigging)을 결합하여 섬세한 감정 연기를 표현할 수 있습니다. 덕분에 대규모 배우 섭외나 복잡한 모션 캡처 과정의 필요성이 줄어듭니다. 또한 AI 기반 아바타는 뛰어난 스타일 적응성을 지닙니다. 기존 에셋을 다시 만들 필요 없이 사실적인 모습과 특정 예술적 스타일 사이를 자유롭게 오갈 수 있습니다.

이처럼 AI는 사전 제작부터 제작, 후반 작업에 이르기까지 영화 제작의 전 과정에서 복잡한 작업들을 자동화할 수 있는 잠재력을 지닙니다. 이를 통해 기존의 영화 제작 파이프라인을 혁신하고, 제작 비용을 절감하며, 작업 흐름을 효율화할 수 있습니다. 나아가 창작자의 의도를 더욱 효과적으로 반영하고, 현실적인 제약을 넘어 더욱 풍부한 상상력의 이야기를 스크린에 구현할 가능성을 열어줍니다.

2.2 AI 영화 제작 워크플로우

초기에 AI는 영화 제작 과정에서 주로 인식(perception) 작업에 활용되었습니다. 예를 들어 장면 분석, 객체 감지, 카메라 보정 등에 AI를 적용하여 편집 및 태깅 작업을 부분적으로 자동화하는 방식이었습니다. 오늘날에는 창의성과 효율성을 동시에 높이기 위해 영화 제작의 모든 단계에서 AI 기술이 폭넓게 활용되고 있습니다.

사전 제작 단계에서는 생성형 언어 모델이 대본 작성 과정을 돕거나 초기 컨셉 아트를 생성하는 데 기여합니다. 또한, 디퓨전 모델(diffusion model) 기반의 스토리보드 생성 기술은 텍스트로 묘사된 장면 설명을 바탕으로 조명이나 기본적인 캐릭터 자세 등을 포함한 예상 샷 구성을 시각화해 줍니다.

제작 단계에서는 실시간 비전 알고리즘이 활용됩니다. 이를 통해 카메라 위치를 자동으로 조정하고, 배우의 동선을 추적하며, CGI 소품 같은 합성 요소를 실제 촬영 장면에 자연스럽게 배치하는 작업 등이 가능해집니다. 더 나아가, 생성형 볼륨 배경(generative volumetric backgrounds) 기술을 이용하면 최소한의 그린 스크린 촬영만으로도 풍부한 디테일의 배경 세트를 즉석에서 구현할 수 있습니다.

후반 작업 단계에서는 샷 자동 분할, 캐릭터 감지, 특수 효과 합성 등의 AI 기술이 활용되어, 기존 편집 과정의 작업 부담을 크게 덜어줍니다. 한편, 무비넷(MovieNet)과 같은 대규모 데이터셋은 다중 모달 주석(multimodal annotations)을 포함하고 있어, 샷 구성, 이야기 구조, 감정 분석 등에 대한 표준화된 평가 기준(벤치마크)을 제공합니다.

영화의 감정적 효과를 높이기 위한 연구도 활발합니다. 연구자들은 시각, 사운드, 편집이라는 세 가지 핵심 미디어 요소에 주목하며, AI를 음악 생성이나 자동 편집 기술에 적용하고 있습니다. 더 나아가, '영웅의 여정(Hero's Journey)'이나 '프라이타크의 피라미드(Freytag's Pyramid)'와 같은 고전적인 서사 구조 이론이 딥러닝 모델에 적용되고 있습니다. 이를 통해 대본의 전개 속도나 캐릭터 발전 과정을 자동으로 분석하고, 이야기 구성에 대한 생성적 지원을 제공받을 수 있게 되었습니다.

종합적으로 볼 때, 생성 모델과 멀티모달 학습 기술이 계속 발전하면서 영화 제작에서 AI의 역할은 더욱 중요해질 전망입니다. 특히 창작 과정 지원, 스타일의 일관성 유지, 관객 몰입도 향상 등 다양한 측면에서 AI의 기여가 커질 것입니다. 이는 영화 산업에 새로운 기회를 제공하는 동시에 해결해야 할 과제들도 함께 제시할 것으로 예상됩니다.

3. 설문 조사

많은 컴퓨터 과학자와 영화 제작자들이 GenAI 툴이 실제 영화 제작 과정에 어떻게 접목되고 있는지 궁금해합니다. 이 섹션에서는 다양한 GenAI 기술의 채택 현황과 함께, 아티스트들이 영화의 완성도를 결정하는 여러 요소들을 어떻게 평가하는지 살펴봅니다. 또한 현재 사용되는 GenAI 툴에 대한 아티스트들의 생각과 미래 영화 제작 기술 발전에 대한 그들의 기대는 무엇인지 조사했습니다.

3.1 GenAI 툴 채택률

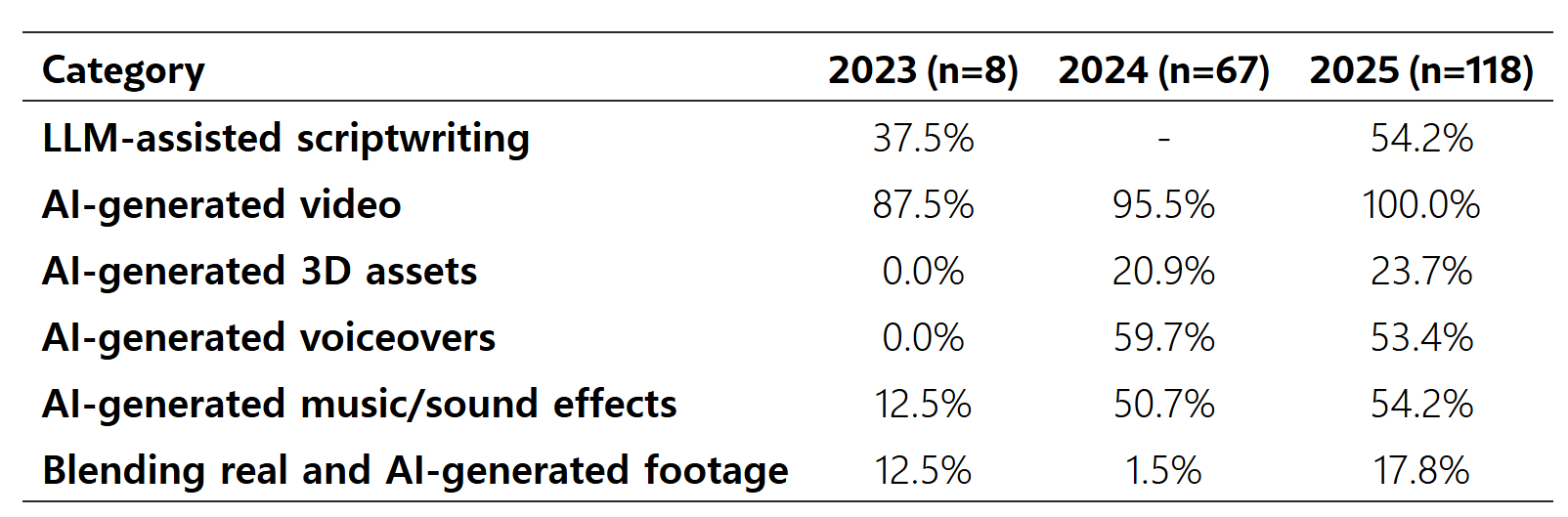

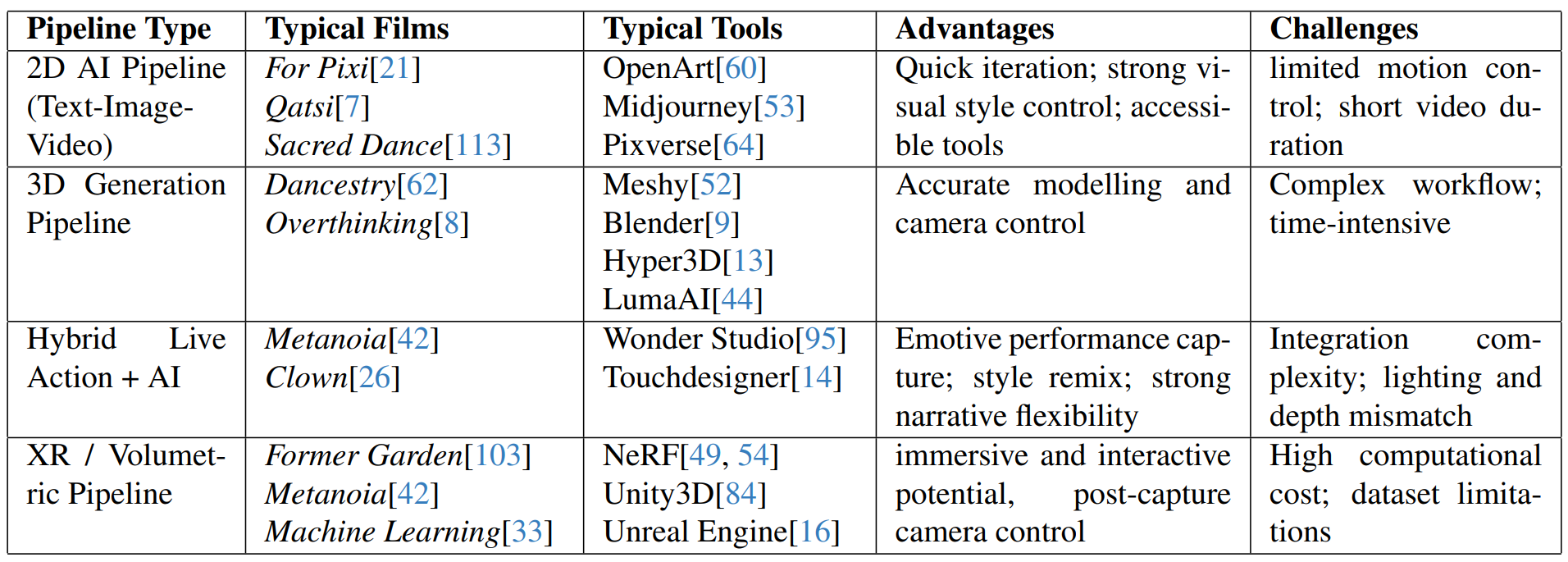

전통적으로 영화 제작은 각본 작성, 영상 생성, 3D 콘텐츠 제작, 음악 작곡, 보이스오버 녹음 등 여러 단계를 거칩니다. 우리는 AI가 이러한 제작 과정의 각 단계에 어떻게 기여할 수 있는지 알아보고자 했습니다. 이를 위해 MIT AI 영화 해커톤에 출품된 작품들에서 다양한 GenAI 툴이 어떻게 사용되었는지 조사했습니다. 이 행사는 참가자들이 AI 기술을 활용하여 단편 영화를 제작하도록 독려하는 자리입니다. 2023년, 2024년, 2025년에 매년 개최된 이 해커톤은 영화 제작 단계별 AI 활용에 대한 귀중한 데이터를 제공합니다(표 1).

조사 결과, 거의 모든 참가자가 작품 제작에 이미지 또는 비디오 생성 AI를 활용했음을 확인했습니다(표 1). AI가 생성하는 시각 이미지의 사실성이 점차 높아지고 있음에도 불구하고, 출품된 영화 대부분은 만화적인 스타일을 유지하는 경향을 보였습니다. 이는 아마도 사실적인 스타일의 영상보다 만화적 스타일에서 일관성이 부족한 부분이 상대적으로 덜 두드러지기 때문일 수 있습니다.

3D 생성 기술은 시간적, 공간적 일관성을 모두 높일 잠재력을 가지고 있습니다. 이러한 점을 고려하여 MIT AI 영화 해커톤 주최 측은 2024년부터 별도의 3D 생성 트랙을 신설했습니다. 그 결과, 3D 툴 사용률은 2023년 0%에서 2025년 23.7%로 눈에 띄게 증가했습니다(표 1). 하지만 이 수치는 여전히 비디오 생성 툴의 채택률보다는 낮습니다(표 1). 이는 AI 기반 3D 생성 기술이 아직 아티스트들의 기대치를 완전히 만족시키지는 못하고 있음을 시사합니다.

2024년에는 출품작의 절반 이상이 AI 보이스오버 기술을 활용했습니다(표 1). 특히 비영어권 참가자들이 AI 보이스오버 툴을 적극적으로 사용하여, 글로벌 관객을 대상으로 한 자연스러운 영어 내레이션을 제작하는 사례가 많았습니다. 이는 AI가 언어 장벽을 넘어 예술적 표현과 콘텐츠 접근성을 어떻게 확장할 수 있는지를 보여주는 좋은 예입니다.

AI를 이용한 음악 및 음향 효과 생성 기술의 채택률 또한 크게 증가했습니다. 2023년 12.5%였던 것이 2024년과 2025년에는 50%를 넘어섰습니다(표 1). 흥미로운 점은, 2025년 대회에서 음악 부문 수상작은 AI 기술 활용이 두드러졌던 다른 작품들과 달리, 인간 작곡가가 만든 곡이었다는 사실입니다. 당시 심사위원들은 AI 사용 여부를 알지 못한 채 순수하게 음악이 주는 감동만을 평가했습니다. 이 결과는 미묘한 감정선과 음악적 변화를 담아내는 데 있어서는 여전히 인간 창작자의 역량이 중요함을 시사할 수 있습니다.

3.2 GenAI 툴과 영화 품질

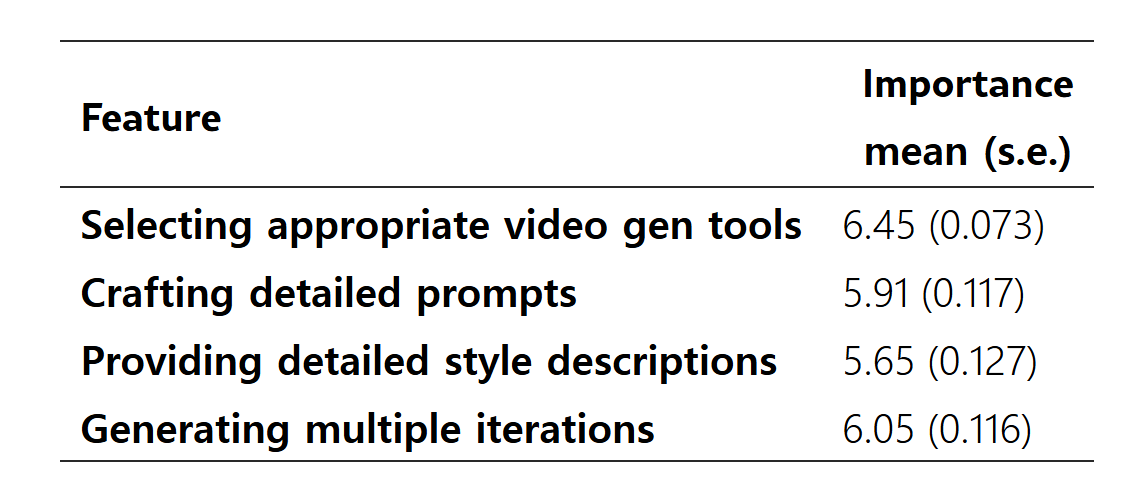

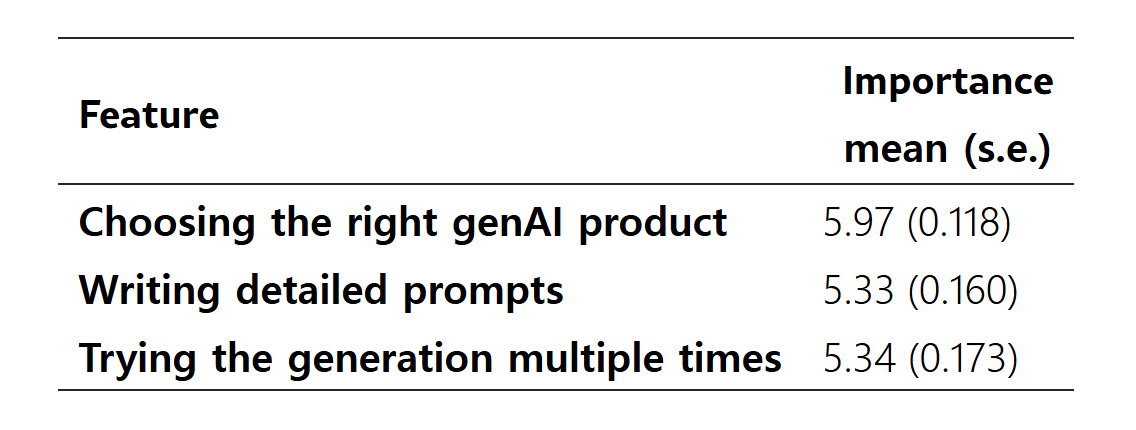

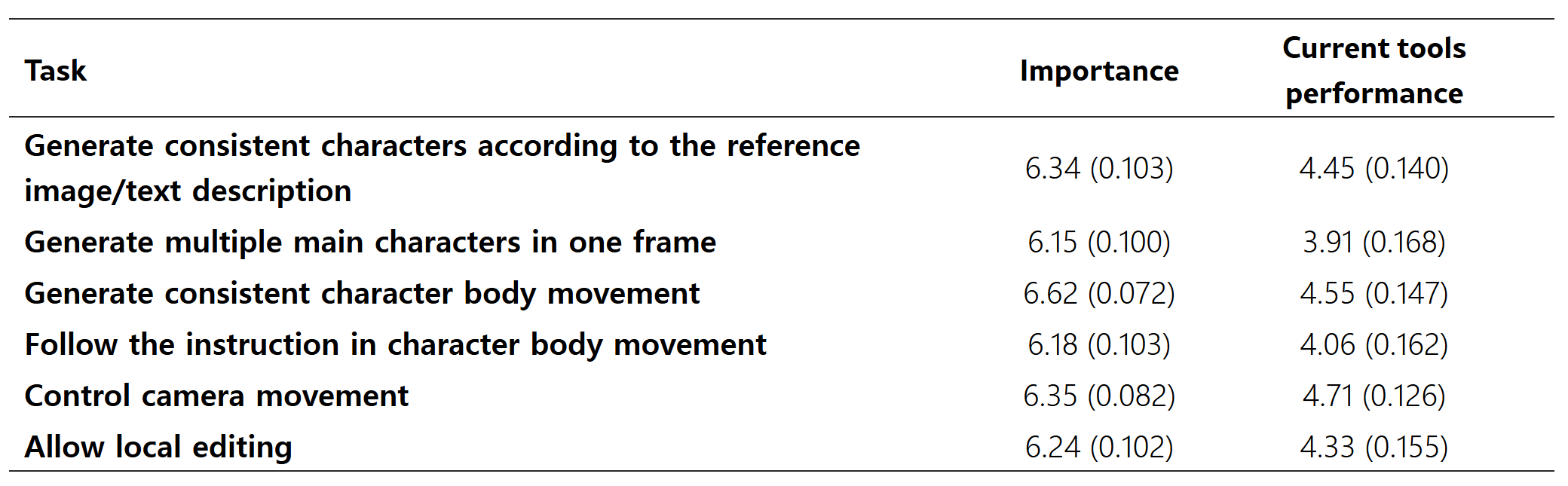

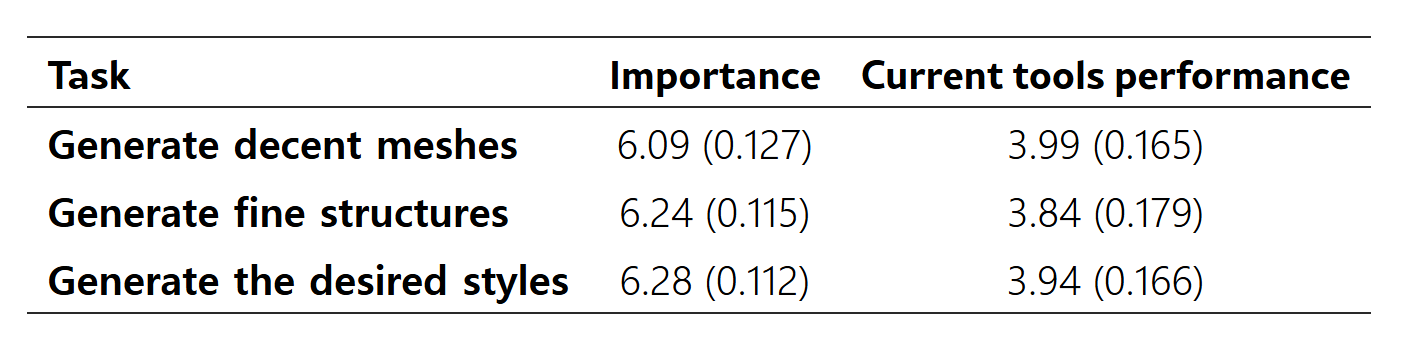

경험이 풍부한 AI 영화 아티스트들을 대상으로 설문 조사를 진행하여, 비디오 생성 툴(표 2)과 3D 생성 툴(표 4)의 주요 기능들에 대한 사용자 선호도를 파악했습니다.

아티스트들은 높은 품질의 영화를 만들기 위해 가장 중요한 요소로 '자신에게 맞는 GenAI 툴을 선택하는 것'을 꼽았습니다. 실제로 아티스트들이 사용하는 툴은 매우 다양했으며, 이는 현재 시장에 여러 경쟁력 있는 툴이 존재함을 보여줍니다.

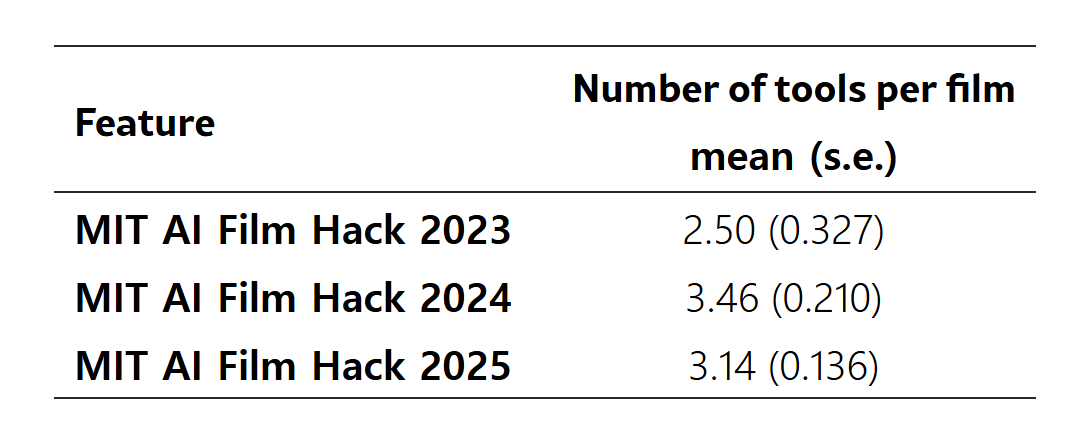

설문에서 언급된 툴로는 미드저니(Midjourney), 클링(Kling), 오픈아트(OpenArt), 런웨이(Runway), 픽스버스(Pixverse) 등이 있었습니다. 주목할 점은 2025년 MIT AI 영화 해커톤 참가 아티스트들이 작품 하나당 평균 세 개의 각기 다른 영상 생성 툴을 사용했다는 사실입니다(표 3). 이는 현재 어떤 단일 툴도 모든 시각적 요구를 완벽히 충족시키지 못하며, 여러 툴을 조합하여 사용하는 것이 보편적임을 시사합니다.

설문 응답자들은 AI가 생성하는 결과물의 예측 불가능성(무작위성)을 줄이기 위해 여러 번 반복하여 생성 작업을 수행할 필요가 있다고 강조했습니다(표 2, 표 4). 또한, 2D 및 3D 작업 모두에서 시각적으로 풍부하고 만족스러운 결과물을 얻으려면 상세한 프롬프트를 작성하는 것이 중요하며, 때로는 프롬프트 개선 툴을 활용하는 것도 도움이 된다고 답했습니다(표 2, 표 4).

3.3 아티스트들의 GenAI 툴에 대한 기대

사용자의 실제 활용 방식도 중요하지만, 궁극적으로는 GenAI 모델 자체가 가진 기능이 영상 품질에 대한 사용자 경험을 좌우합니다. 아티스트 대상 설문 결과(표 5)를 보면, 비디오 생성 툴에서 가장 중요하게 생각하는 것은 '캐릭터 움직임의 일관성'이었습니다. 그 다음으로는 '카메라 제어 기능'과 '전반적인 캐릭터 표현의 일관성' 순서였습니다.

이는 실제 영화 촬영 환경에서는 물리 법칙에 따라 자연스럽게 시공간적 일관성이 유지되는 것처럼, GenAI 결과물 역시 그 정도의 자연스러움과 일관성을 보여주기를 바라는 아티스트들의 기대를 반영합니다.

사용자들은 카메라 각도를 보다 정교하게 제어할 수 있기를 원했습니다. 실제 영화 제작에서 카메라 움직임은 복잡한 3차원 경로를 따릅니다. 여기에는 단순히 '왼쪽으로 0.1에서 10만큼 패닝' 같은 단일 동작 지시뿐만 아니라, 카메라의 시작 위치, 초점 거리, 피사계 심도 등 다양한 요소가 포함됩니다.

하지만 현재 GenAI 툴에 이러한 복합적인 요소들을 정확히 지시하기는 어렵습니다. 또한 모델들은 훈련 데이터 부족 등의 이유로 드론 샷이나 원거리 촬영 같은 특정 시점을 구현하는 데 종종 어려움을 보입니다.

캐릭터 움직임 제어에 대한 요구 역시 매우 높게 나타났습니다(표 5). 이는 개별 영상 클립 안에서 캐릭터의 표현력을 높이는 움직임뿐만 아니라, 카메라 앵글이 바뀌어도 캐릭터의 움직임이 일관되게 이어지는 것을 모두 포함하는 개념입니다. 또한, 하나의 프레임 안에 여러 캐릭터를 동시에 생성하는 기능에 대한 관심도 높았습니다(표 5). 특히 긴 길이의 영상을 제작하며 복잡한 이야기를 만들고자 하는 사용자들 사이에서 이러한 요구가 두드러졌습니다.

사용자들의 3D 생성 툴에 대한 평가도 조사했는데, 비디오 생성 툴에 비해 만족도가 상대적으로 낮았습니다. 많은 사용자들이 생성된 3D 메시(mesh)가 원하는 스타일을 제대로 반영하지 못하거나, 메시 토폴로지(mesh topology)가 적절하지 않은 경우가 많다고 응답했습니다(표 6). 또한 상당수의 3D 생성 툴은 속이 빈 구조(hollow designs)나 복잡하고 세밀한 부분(fine structures)을 표현하는 데 어려움을 겪는 것으로 나타났습니다(표 6).

4. 사례 연구

생성형 AI는 영화 제작에 새로운 미학적, 서사적 전략을 도입하고 창의적 제어에 대한 새로운 접근 방식을 요구하며 영화 제작 방식을 바꾸고 있습니다. MIT AI 영화 제작 해커톤 수상작 분석을 통해, 아티스트들이 이러한 변화의 환경 속에서 다양한 영역을 어떻게 탐색하고 있는지 살펴봅니다.

4.1 시각적 스토리텔링 사례 연구

생성형 AI는 미학적 일관성, 샷 구성, 카메라 움직임 등을 지원하며 새로운 방식의 시각적 스토리텔링을 가능하게 합니다. 하지만 이야기의 일관성을 유지하고 원하는 스타일을 제어하기 위해서는 여전히 사람의 창의적인 개입이 중요합니다.

미학적 스타일링

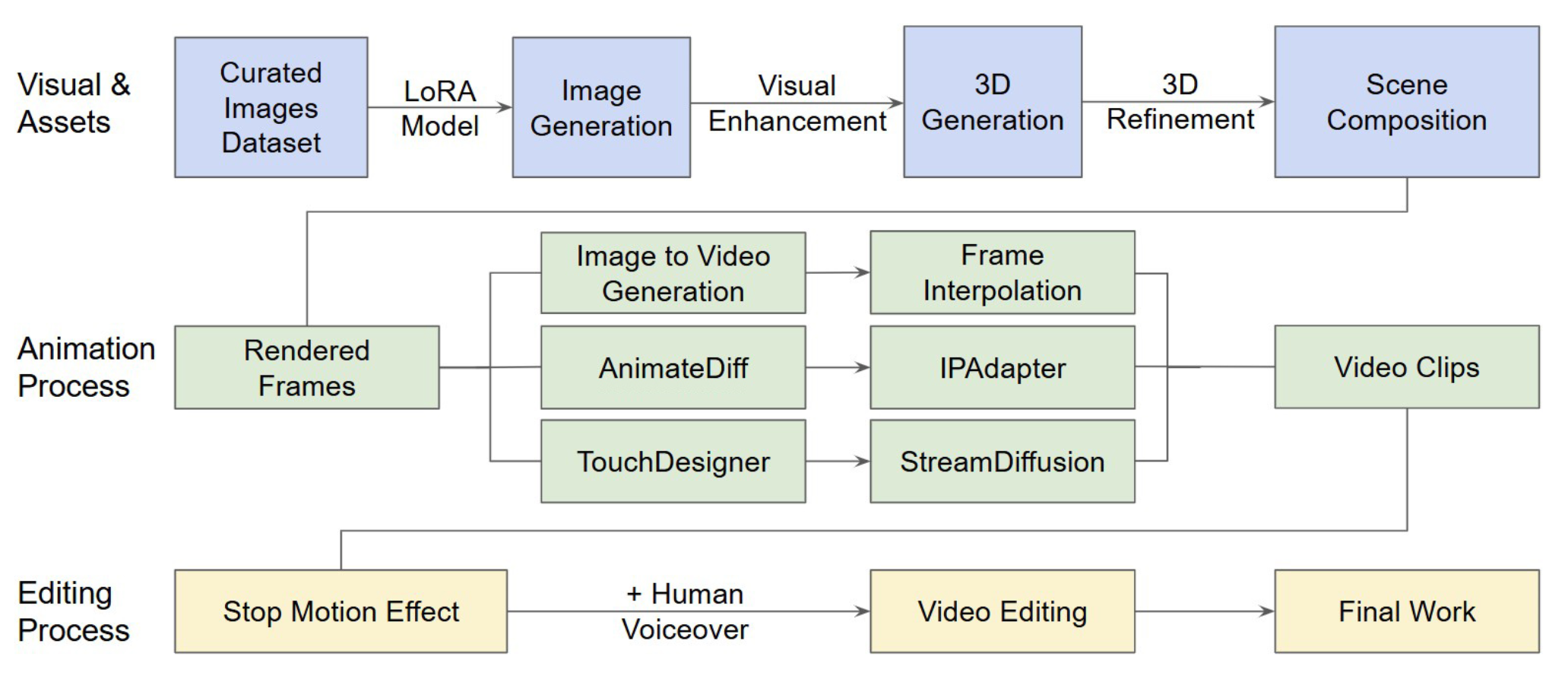

아티스트들은 작품 전체에 걸쳐 독특하면서도 일관된 시각적 스타일을 구현하기 위해 AI 툴과 전통적인 영화 제작 기법을 함께 사용합니다. 여기에는 프롬프트 엔지니어링, 이미지 레퍼런스 활용, 로라(LoRA) 모델 훈련, 애니메이트디프(AnimateDiff)와 같은 툴 사용 등이 포함됩니다. 아티스트들은 종종 이러한 AI 기반 기법에 손그림, 디지털 콜라주, 후반 작업 등을 결합하여 원하는 시각적 효과를 만들어냅니다.

첫째, 아티스트들은 텍스트 설명이나 시각 레퍼런스를 활용하여 AI 툴이 일관된 스타일을 생성하도록 유도할 수 있습니다. 예를 들어, 영화 「O.R.V. 8」은 초기 다중 노출 사진 기법의 동작 연구 이미지를 레퍼런스로 사용하여 역사적인 미학과 현대적인 색감을 융합했습니다.

마찬가지로, 「깨어나려는 꿈 (A Dream About to Awaken)」은 손으로 그린 스토리보드를 AI 이미지 해석 툴로 분석하여 얻은 프롬프트를 기반으로 작업했습니다. 이를 다양한 색상과 스타일로 변형하며 독특한 시각 언어를 구축했습니다(그림 1).

둘째, 영화 「라운드 테이블 (Round Table)」의 사례처럼, 손으로 그린 스케치가 생성형 AI 툴의 스타일 기반이 될 수도 있습니다. 이 작품에서는 초기 스케치와 디지털 콜라주가 AI 생성 과정의 길잡이 역할을 하여 시각적 일관성을 확보했습니다.

셋째, 특정 시각 스타일을 구현하기 위해 맞춤형 로라(LoRA, Low-Rank Adaptation) 모델을 훈련시키는 것도 많이 사용되는 접근법입니다. 예를 들어, 단편 영화 「오버씽킹 (Overthinking)」은 중세 시대 장난감 이미지 50개로 훈련한 전용 로라 모델을 사용하여 향수를 자극하는 미니멀리즘 미학을 구현했습니다.

이 영화는 애니메이션 시퀀스 전체에 걸쳐 스타일의 일관성(특히 채팅 버블 같은 요소)을 유지하기 위해, 컴피UI(ComfyUI) 워크플로우 상에서 애니메이트디프(AnimateDiff)와 IP어댑터를 함께 활용했습니다.

마지막으로, AI가 생성한 시각 결과물을 다듬는 데에는 전통적인 후반 작업 기법이 여전히 중요합니다. 영화 「카치 (Qatsi)」는 AI로 생성한 추상적인 이미지에 필름 그레인 효과와 색 보정을 더하여, 초현실적인 몽타주에 초기 영화와 같은 아날로그적 질감을 부여했습니다.

유사하게, 「라운드 테이블 (Round Table)」의 제작진은 포토샵(Photoshop)이나 캡컷(CapCut) 같은 일반 편집 소프트웨어를 사용하여 AI 생성 에셋을 수작업으로 보정하고 조합함으로써 손으로 만든 듯한 느낌을 더했습니다.

샷 구성 및 카메라 제어

생성 모델은 때로 인상적인 시각 결과물을 만들어내지만, 시간적 연속성을 유지하거나 구도를 정교하게 제어하는 데는 어려움을 겪는 경우가 많습니다. 이는 긴 이야기를 풀어가는 데 있어 AI 활용의 한계점으로 작용합니다. 아티스트들은 이러한 한계를 극복하기 위해 프레임 보간(frame interpolation), 시작/종료 프레임 일관성 기법, 하이브리드 3D 파이프라인 활용 등 다양한 방법을 사용합니다.

'시작 및 종료 프레임'을 지정하는 접근 방식은 일관된 카메라 움직임과 자연스러운 장면 전환을 구현하는 데 도움을 줍니다. 이를 통해 초기 프레임 이후의 내용을 안정적으로 생성하고, 끊김 없는 '원테이크' 촬영 효과를 연출할 수도 있습니다.

예를 들어, 영화 「보이지 않는 여성들 (Invisible Women)」은 이 방식을 활용하여 AI로 생성된 여러 장면 조각들을 하나의 완벽한 원테이크 시퀀스처럼 연결했고, 이를 통해 독특한 시각적, 서사적 스타일을 구현했습니다.

정밀한 카메라 제어를 위해 3D 기술을 활용하는 것 또한 주요 전략 중 하나입니다. 영화 「댄세스트리 (Dancestry)」가 좋은 예시인데, 이 작품은 주로 AI를 이용해 섬세한 3D 에셋, 리깅(rigging), 표정 등을 생성했습니다. 그 다음, 이를 블렌더(Blender) 소프트웨어에서 애니메이션 작업과 렌더링을 진행하여 카메라 경로를 매우 세밀하게 제어할 수 있었습니다.

데이터셋 편향 문제

AI 모델 학습에 사용되는 데이터셋 자체에 내재된 편향은 편견 없는 시각 결과물을 생성하는 데 있어 중요한 문제입니다. 대표적인 예로 직업 관련 성별 편향을 들 수 있습니다. 학습 데이터에서 특정 직업이 주로 남성으로 묘사된 경우, 해당 직업에 대한 인물을 생성하라는 지시를 받으면 모델이 남성 인물을 우선적으로 생성하는 경향이 나타납니다.

영화 「보이지 않는 여성들 (Invisible Women)」은 이러한 AI 생성 결과물 속 직업적 고정관념을 정면으로 다루고자 시도했습니다. 이 영화의 아티스트들은 프롬프트와 모델 설정을 세심하게 조정하여 여성을 보다 사실적으로 표현하려 노력했으며, 이를 통해 기존의 고정관념에 적극적으로 도전했습니다.

4.2 새로운 예술적 표현 방식의 사례 연구

일부 AI 아티스트들은 전통적인 영화 제작 기법을 단순히 모방하는 것을 넘어섭니다. 이들은 생성 모델의 무작위성이나 시각적 불완전함처럼 단점으로 여겨지던 특징들을 오히려 새로운 창작 툴로 받아들입니다. 그리고 이러한 특징들을 예술적 표현을 위한 가치 있는 자원으로 재해석하고 있습니다.

무작위성을 창의적 이점으로 활용하기

AI 결과물의 예측 불가능성은 때로 주제 의식과 잘 맞아떨어질 때 효과적인 스토리텔링 장치가 될 수 있습니다. 영화 「크라운 (CLOWN)」은 미드저니(Midjourney)의 무작위 생성 기능을 심리 묘사를 위한 서사적 툴로 활용했습니다. 이 작품은 스톱모션 애니메이션에서 영감을 받아 프레임 단위로 스타일을 적용하는 기법을 사용했습니다.

각 프레임을 개별적으로 AI 처리하여, 일관된 아트 스타일 속에서도 미묘한 변화를 만들어 냈습니다. 이는 시각적 통일성을 유지하면서 동시에 주인공의 분열된 정체성을 효과적으로 반영했습니다. 이러한 방식으로, 영화는 AI의 비일관성을 광대가 점차 자아를 잃어가는 과정을 절절하게 보여주는 표현 기법으로 승화시켰습니다(그림 3).

이미지 생성의 불완전함을 미학으로 활용하기

AI가 생성한 결과물의 시각적 불완전함, 예를 들어 흐릿한 경계선, 비정상적인 비율, 일관성 없는 조명 등은 그 자체로 독특한 미학적 특징으로 활용될 수 있습니다. 영화 「카치 (Qatsi)」는 추상적인 이미지를 통해 감정적, 철학적 주제를 전달합니다.

이를 위해 흑백 화면, 4:3 화면 비율, 그리고 소비에트 몽타주 이론에 기반한 추상적 서사 구조를 채택했습니다. 데이비드 린치(David Lynch)의 영화 철학에서 영감을 받은 이 프로젝트는, 종종 기술적 결함으로 여겨지는 생성 이미지의 불완전함, 불규칙성, 오류 등을 적극적으로 수용합니다. 그리고 이를 예술적 표현을 위한 툴로 재해석했습니다.

AI로 전통적인 애니메이션 기법 재해석하기

AI는 영상의 시간 해상도나 이미지 품질을 의도적으로 조절함으로써 전통적인 애니메이션의 미학을 재현하고 발전시킬 수도 있습니다. 영화 「오버씽킹 (Overthinking)」은 애프터 이펙트(After Effects) 프로그램에서 프레임 속도를 초당 12~15 프레임으로 낮췄습니다.

이를 통해 AI 생성 과정에서 발생할 수 있는 움직임 오류(아티팩트)로 인한 시청자의 어색함을 줄이는 동시에 스톱모션 애니메이션 특유의 느낌을 구현했습니다. 마찬가지로, 영화 「라운드 테이블 (Round Table)」은 AI로 생성한 에셋과 전통적인 애니메이션 기법을 결합했습니다. 결과물을 스톱모션 스타일로 조합하여, 일반적으로 매끈한 AI 이미지와는 대조적으로 손으로 직접 만든 듯한 질감을 표현했습니다.

실험적 3D 미학

AI로 생성된 3D 에셋은 다각형 메시(mesh) 형태를 넘어 다양한 모습으로 나타날 수 있습니다. 예를 들어 가우시안 스플래팅(Gaussian Splatting)의 공간적 스플랫(spatial splats)과 같은 볼륨 표현 방식은 AI 기반의 공간적 스토리텔링에 새로운 가능성을 열어줍니다.

영화 「메타노이아 (Metanoia)」나 「기억 속 마장마술 행진 (Dressage Marching Through Memories)」 같은 작품들은 가우시안 스플랫(Gaussian Splat) 기법을 활용했습니다. 이를 통해 초현실적이고 유동적인 시각 환경을 조성하여, 마치 단편적이고 희미해지는 기억처럼 공백과 왜곡이 가득한 향수 어린 분위기를 자아냅니다.

4.3 GenAI를 활용한 캐릭터 제작 사례 연구

AI 영화 제작에서 캐릭터 디자인은 일관성, 감정 표현의 깊이, 그리고 기술적 유연성 사이의 균형을 필요로 합니다. 생성 툴은 빠른 시제품 제작(프로토타이핑)을 가능하게 해주지만, 최종적으로 캐릭터의 연속성과 표현력을 확보하기 위해서는 아티스트의 반복적인 개선 작업과 세심한 개입이 필수적입니다.

캐릭터 디자인 및 시각적 일관성

AI는 서로 다른 개념들을 혼합하여 상상력이 풍부한 캐릭터 디자인을 만들어낼 수 있습니다. 하지만 여러 장면에 걸쳐 캐릭터의 모습을 일관되게 유지하려면 정교한 프롬프트 작성과 수작업 보정이 필요합니다. 영화 「리푸 마을 이야기 (Tale of Lipu Village)」에 등장하는 '브로콜리를 기르는 양'이나 '계란 프라이 모양의 꽃' 같은 캐릭터들이 좋은 예입니다.

이는 서로 관련 없어 보이는 요소들을 하나의 통일된 미학으로 융합하는 AI의 능력을 보여주며, 이러한 디자인은 전통적인 방식으로는 구현하기 어렵습니다. 영화 「E-스파크의 춤 (Dance of E-Spark)」은 특정 스타일에 맞는 프롬프트를 사용하고 포토샵(Photoshop)으로 후처리 작업을 거쳐 로봇 캐릭터의 시각적 일관성을 확보했습니다.

AI로 영화를 만들 때 여러 장면에 걸쳐 캐릭터의 특징을 일관되게 유지하는 것은 특히 어려운 과제입니다. 영화 「픽시를 위하여 (For Pixi)」는 반복적인 수정과 프롬프트 엔지니어링의 중요성을 잘 보여줍니다. 이 작품은 미드저니(Midjourney)로 이미지를 생성할 때마다 'A claymation, puppet-style 3D animation world'라는 동일한 프롬프트를 꾸준히 사용했습니다.

그럼에도 눈 모양이 조금씩 달라지는 등 미세한 불일치는 계속 발생했습니다. 이때 미드저니의 영역별 편집 툴 같은 기능들이 유용하게 사용되었습니다. 아티스트들은 프롬프트를 조금씩 바꿔가며 매번 30~40개의 변형 이미지를 생성하고, 부정적인 프롬프트(negative prompt)를 활용해 원치 않는 요소가 나타나지 않도록 했습니다. 이를 통해 불필요한 불일치를 최소화하고 영화 전체에 걸쳐 캐릭터의 일관성을 유지할 수 있었습니다(그림 4).

캐릭터 움직임과 감정

AI 캐릭터 제작에서 기술적으로 가장 어려운 부분 중 하나는 실감 나는 움직임과 감정을 표현하는 것입니다. 이를 위한 접근 방식은 텍스트 프롬프트로 움직임을 묘사하는 것부터 실시간 모션 캡처 데이터를 활용하는 것까지 다양합니다. 영화 「O.R.V. 8 진동하는 리듬의 바이닐 (O.R.V. 8 Oscillating Rhythmic Vinyl)」의 경우, 배우가 간단한 그린 스크린 앞에서 연기한 모습을 카메라로 촬영했습니다.

그 다음 원더 스튜디오(Wonder Studio)를 사용하여 이 배우의 연기를 완전한 애니메이션 로봇 캐릭터의 움직임으로 변환했습니다. 이렇게 만들어진 결과물은 어도비 애프터 이펙트(Adobe After Effects)와 어도비 프리미어 프로(Adobe Premiere Pro)를 사용하여 AI로 생성된 배경과 합성되었습니다. 이를 통해 인간 배우의 표현력과 AI 기반의 미학이 자연스럽게 결합된 장면을 보여주었습니다.

AI로 생성된 캐릭터라 할지라도 감정을 전달하는 것은 매우 중요합니다. 영화 「마지막 춤 (The Last Dance)」은 '감정 기반 애니메이션(emotion-driven animation)' 방식을 활용했습니다. 각 장면마다 캐릭터가 어떤 감정을 어떤 움직임으로 표현해야 하는지를 프롬프트를 통해 명확하게 지시했습니다.

4.4 영화 제작에서의 3D 생성 사례 연구

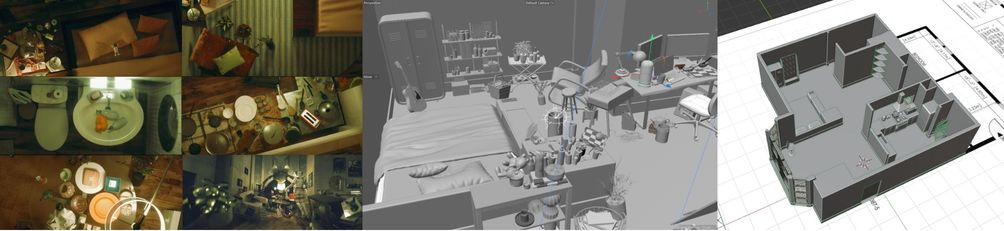

AI를 이용한 3D 생성은 직접 모델링하는 것보다 훨씬 빠르다는 장점이 있습니다. 하지만 여전히 품질 관리, 리깅(rigging) 작업, 스타일 일관성 유지 등을 위해서는 사람의 손길이 필요합니다. 현재 사용되는 툴들은 메시 토폴로지(mesh topology) 구성, 애니메이션 적용 준비, 추상적인 디자인 구현의 유연성 등에서 아직 한계를 보이고 있습니다.

실사 영상과 3D 콘텐츠 혼합

AI로 생성한 3D 캐릭터를 실제 촬영 영상(실사) 환경에 자연스럽게 합성하려면 조명, 깊이감, 원근 등을 정밀하게 제어해야 합니다. 영화 「크라운 (CLOWN)」 같은 작품은 원더 스튜디오(Wonder Studio)를 사용했습니다. 원더 스튜디오는 애니메이션, 조명 설정, CG 캐릭터를 실제 장면에 합성하는 과정을 자동화해주는 AI 파이프라인입니다.

원더 스튜디오는 조명과 깊이 정보를 세밀하게 조정하여 디지털 캐릭터가 실사 영상의 카메라 각도 및 환경과 완벽하게 어우러지도록 합니다. 이를 통해 실사 영상과 CG가 결합된 장면의 사실감을 높여줍니다.

3D 에셋 및 장면 생성

루마 AI(Luma AI), 메시(Meshy), 하이퍼3D(Hyper3D)와 같은 툴은 3D 에셋 제작 속도를 획기적으로 단축시킵니다. 영화 「어항 (Fish Tank)」 제작 과정에서 아티스트들은 사진-3D 변환, 텍스트-3D 변환, 이미지-3D 변환 등 다양한 파이프라인을 시험했습니다.

그 결과, 기존에 1~2시간 걸리던 모델링 시간을 5분 미만으로 줄여 90% 이상 단축하는 효과를 보았습니다. 어떤 툴은 실제 환경을 정밀한 3D 메시로 캡처하는 기능을 제공하고, 또 다른 툴은 텍스트 프롬프트나 2D 이미지를 단 몇 분 만에 바로 사용 가능한 3D 모델로 변환해 줍니다.

하지만 영화 「어항 (Fish Tank)」 제작 과정에서는 AI 기술의 몇 가지 한계점도 확인되었습니다. 첫째, UV 매핑 및 재질 적용 문제입니다. 메시(Meshy) 툴의 초기 UV 매핑 기능은 다소 부족하여, 정확한 텍스처를 입히기 위해서는 추가적인 수작업 조정이 필요했습니다. 이후 쿼드(quad) 기반 토폴로지 도입 등 기능 개선이 이루어져 에셋 활용성은 높아졌지만, 여전히 보완이 필요한 부분이 있었습니다.

둘째, AI가 생성한 메시 구조는 애니메이션 작업에 바로 적용하기 어려운 경우가 많았습니다. 즉, 애니메이션에 적합한 토폴로지(animation-ready topology)를 갖추지 못하는 문제가 있었습니다. 생성된 모델 자체가 다소 경직되고 기계적인 느낌을 주어, 별도의 리토폴로지(retopology) 작업 없이는 스켈레탈 리깅(skeletal rigging)이나 디포메이션(deformation) 작업에 적합하지 않았습니다.

셋째, AI는 매우 창의적이거나 복잡하고 추상적인 형태의 객체를 생성하는 데 어려움을 보였습니다. 종종 단순하고 표준적인 기하학적 형태로 결과물이 회귀하는 경향이 나타났습니다. 이는 매우 개념적이거나 초현실적인 장면을 구현하는 데 있어 AI 활용을 제한하는 요인이 되었습니다(그림 5).

4.5 XR 영화 제작에서의 AI 사례 연구

AI는 실시간 합성, 몰입형 카메라 제어, 볼륨 스토리텔링(Volumetric storytelling) 등의 기술을 통해 XR(확장 현실) 영화 제작 환경을 바꾸고 있습니다. 이러한 기술 발전은 감독의 창의적인 툴킷(toolkit)을 확장시키고, 전통적인 영화 감상 경험과 상호작용형(인터랙티브) 경험 사이의 경계를 허물고 있습니다.

AI 보조 몰입형 비디오

AI는 모션 캡처 자동화, 장면 생성, 실시간 합성 등의 기능을 통해 몰입형 영화 제작 기술을 발전시키고 있습니다. 예를 들어, 작품 「머신러닝 (Machine Learning)」에서는 모션 캡처로 기록된 애니메이션 데이터를 원더 스튜디오(Wonder Studio)와 같은 AI 툴을 사용하여 180도 입체 영상에 합성했습니다.

이 툴은 복잡한 신체 움직임과 손동작까지 정확하게 캡처하여 자연스러운 합성을 가능하게 했습니다. 또한, 프로젝트 리프레임(Project Reframe)은 VR 환경 내에서의 상호작용 정확도를 높였습니다. 헤드셋에 달린 카메라를 사용하여 사용자의 손 제스처를 추적하는 기능을 구현했습니다.

AI 볼류모그래피

너프(NeRF), 가우시안 스플래팅(Gaussian Splatting), 포인트 클라우드 렌더링(Point Cloud Rendering) 같은 기술에 기반한 볼륨 영화 제작(Volumetric filmmaking)은 장면 촬영과 카메라 제어를 분리함으로써 기존의 영화 제작 방식을 재정의합니다. 고정되고 개별적인 프레임에 의존하는 전통적인 영화 제작 방식과 달리, 볼류모그래피는 장면 전체를 동적으로 탐색 가능한 3D 또는 4D 데이터셋으로 기록합니다.

예를 들어, 영화 「메타노이아 (Metanoia)」는 너프(NeRF) 기반 파이프라인을 사용하여 무용수의 움직임을 캡처했습니다. 이후 후반 작업 단계에서 다양한 카메라 움직임을 자유롭게 탐색하며 편집하여, 일반적인 촬영 계획 순서와는 다른 방식으로 작업했습니다.

이러한 비선형적 제작 과정은 감독이 주요 촬영 이후에도 영상의 템포, 구도, 시점 등을 자유롭게 실험할 수 있게 해줍니다. 마찬가지로, 영화 「이전의 정원 (Former Garden)」은 주인공의 잠재의식을 표현하기 위해 파편화된 기억들을 포인트 클라우드(Point Cloud) 형태로 시각화했습니다. 이는 볼류모그래피가 인물의 내면을 묘사하는 스토리텔링에도 효과적으로 사용될 수 있음을 보여줍니다(그림 6).

볼류모그래피는 공간 컴퓨팅(spatial computing) 기술과 영화적 스토리텔링을 결합합니다. 이를 통해 아티스트들은 재촬영의 제약에서 벗어나고, 카메라 움직임을 자유롭게 구현하며, 실사와 CG를 더욱 자연스럽게 통합할 수 있습니다.

이처럼 볼류모그래피는 아티스트에게 이전에는 없던 높은 수준의 유연성을 제공하며, XR 환경에서의 몰입형 및 상호작용형 내러티브 경험을 혁신하고 있습니다.

4.6 영화 제작에서의 창의적 기술 사례 연구

AI는 창작자의 비전과 생성형 AI의 기능을 결합하여, 영화 제작 과정에서 새로운 창의적 워크플로우를 열어주고 있습니다.

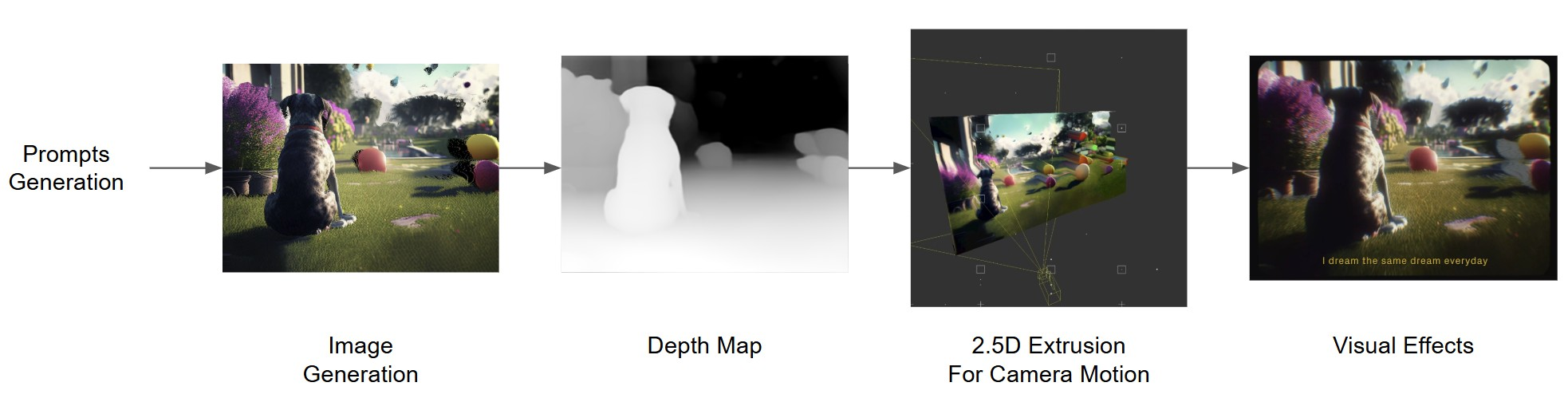

인간과 AI의 협업 방식

AI는 완전히 자율적인 시스템으로 작동하기보다 인간 창작자와 협력하는 파트너로 활용될 때 더욱 효과적입니다. 2023년 최우수 영화상을 수상한 「DOG: 은하수의 꿈 (DOG: Dream of Galaxy)」은 고성능 AI 비디오 생성 툴이 널리 보급되기 전에 제작된 작품입니다. 제작진은 먼저 이야기의 일관성을 확보하기 위해 스크립트를 기반으로 프롬프트 엔지니어링 작업을 진행했습니다. 미드저니(Midjourney)로 생성한 이미지는 스테이블 디퓨전(Stable Diffusion)을 이용해 깊이 맵(depth map)을 생성하는 데 사용되었습니다.

이렇게 깊이 정보가 추가된 이미지를 시네마 4D(Cinema 4D)로 불러와 2.5D 모델로 만들었습니다. 이를 통해 카메라 움직임과 초점 심도, 구도를 정밀하게 제어할 수 있었습니다.

AI로 생성된 목소리에는 기계 작동 소리를 연상시키는 전자음향 효과와 수동으로 적용한 리버브(reverb) 효과를 더해 완성도를 높였습니다. 이 혁신적인 워크플로우는 AI 생성 콘텐츠와 전통적인 영화 제작 기법을 효과적으로 결합하여, 영화적 표현에서 인간과 AI 협업의 가능성을 보여줍니다.

하이브리드 실사, 2D 및 3D 워크플로우

생성 툴과 실제 촬영 영상(실사)을 통합하면, 아티스트는 하나의 통일된 시각적 틀 안에서 실제적인 요소와 인공적인 요소를 나란히 배치하여 독특한 효과를 창출할 수 있습니다.

인류가 디지털 마스크에 지배당하는 디스토피아 세계를 그린 영화 「메타노이아 (Metanoia)」는 차가운 알고리즘적 정교함과 춤이 가진 원초적인 감정을 대비시킵니다. 주인공이 인간성을 되찾으려는 투쟁 과정은 실시간 AI 기술 통합을 통해 시각화됩니다.

터치디자이너(TouchDesigner)와 스테이블 디퓨전(Stable Diffusion)을 사용하여 역동적이고 추상적인 시각적 질감을 생성하고, 이를 실사 영상과 혼합하여 주인공의 영역을 침범하는 AI를 상징적으로 보여줍니다.

또한 루마 AI(Luma AI)로 무용수의 움직임을 3D로 캡처한 뒤, AI 효과를 이용해 이미지를 왜곡시켜 유동적이고 초현실적인 형태로 변형시켰습니다. 이러한 신체적 연기와 디지털 추상화의 융합은 춤을 저항의 상징으로 효과적으로 승화시킵니다.

AI 생성 영상 및 음악의 비선형 편집

AI는 후반 작업 단계에서도 새로운 시간 구성 전략을 가능하게 합니다. 특히 사운드와 영상을 병행하여 제작할 때 더욱 그렇습니다. 영화 「픽시를 위하여 (For Pixi)」에서는 비선형 편집 기법을 사용하여, AI로 생성한 음악 및 사운드 디자인을 점진적으로 발전하는 영상과 긴밀하게 동기화했습니다.

영상이 최종 편집된 후 음악을 입히는 전통적인 방식 대신, 영상 제작과 음악 작곡을 동시에 진행하며 프리미어 프로(Premiere Pro)와 에이블톤 라이브(Ableton Live) 사이에서 수시로 피드백을 주고받으며 반복적으로 수정, 발전시켰습니다.

사운드와 이미지 생성 간의 이러한 역동적인 상호작용은 더욱 응집력 있고 감정적 울림이 있는 시청각 경험을 만들어냈습니다. AI 생성 음악이 가진 유연성 덕분에 지속적인 수정이 가능했고, 아티스트는 후반 작업 전 과정에 걸쳐 이야기의 리듬을 세밀하게 다듬을 수 있었습니다.

5. 결론

요약하자면, 본 논문은 영화 제작 분야에서 생성형 AI 활용의 주요 발전 양상을 살펴보고, 캐릭터 애니메이션, 미학적 스타일링, 3D 에셋 생성 등 다양한 작업에 미치는 영향을 검토했습니다(표 7). AI 기반 워크플로우는 제작 비용을 절감하고 창의적인 실험의 폭을 넓히는 장점이 있지만, 동시에 여러 어려움도 안고 있습니다.

특히 캐릭터의 일관성 유지, 미묘한 움직임 제어, AI 생성 결과물과 실사 영상의 자연스러운 혼합 등에서 해결해야 할 과제가 남아있습니다. 앞으로 생성형 AI 툴이 더욱 발전하고 창작 커뮤니티가 이에 적응해 나가면서, 아티스트와 AI는 점점 더 긴밀하게 통합된 워크플로우를 통해 기존의 경계를 넘어서는 새로운 영화적 경험을 만들어 나갈 것으로 기대됩니다.

본 콘텐츠는 2025년 4월 11일에 Arxiv에 발행된 "Generative AI for Film Creation: A Survey of Recent Advances" 논문을 번역한 것입니다.

저는 전문 번역가가 아니기 때문에 오역이 있을 수 있습니다. 또한 본 글은 원저작자의 요청에 따라 불시에 삭제될 수 있습니다. 감사합니다.

의견을 남겨주세요