안녕하세요, 여름씨입니다.

뮤직데이터그램 다섯 번째는 제가 흥미롭게 읽은 따끈따끈한 자료를 소개합니다.

음악산업 혹은 콘텐츠 산업의 현직 데이터분석가로 살다 보면, 최신 기술을 활용하자는 목표 하에 주로 두 가지 방향을 마주칩니다. 1) 개인화된 콘텐츠 추천을 한다. 2) 콘텐츠(제작 혹은 수급)을 자동화한다. 아마 전현직자 분들은 공감하실 것 같아요.

이 두 가지 갈래 모두 만만치 않은 일이지만, 그 이외에 음악산업에서 데이터를 잘 활용할 미래 방향성이 없을까? 다른 곳에서는 무엇을 하고 있을까? 이런 점이 궁금했던 차에, 마침 현 바이트댄스 - 다들 아시다시피, 틱톡 - 의 AI lab의 Senior Research Scientist 최근우 님이 <인공지능의 음악인지 모델>에 관하여, 제65차 한국음악지각인지학회의 기조 강연을 진행하신 내용을 보았습니다.

사실 음악 인공지능에 대해 한 판 정리된 내용이 없던 터라 반가웠는데요, 발표 영상과 발표 자료가 공개되어 있으나, 영상만 해도 1시간이 넘는 분량으로 주로 음악 AI 연구자들이 무슨 일을 하고 있는지, 기술적 이야기가 많습니다. 바쁘다 바빠 현대사회를 사는 구독자분들을 위해, 발표자료를 짧게 소개하고, 음악 인공지능이 적용된 사례를 함께 첨부할게요.

음악 AI는 무엇?

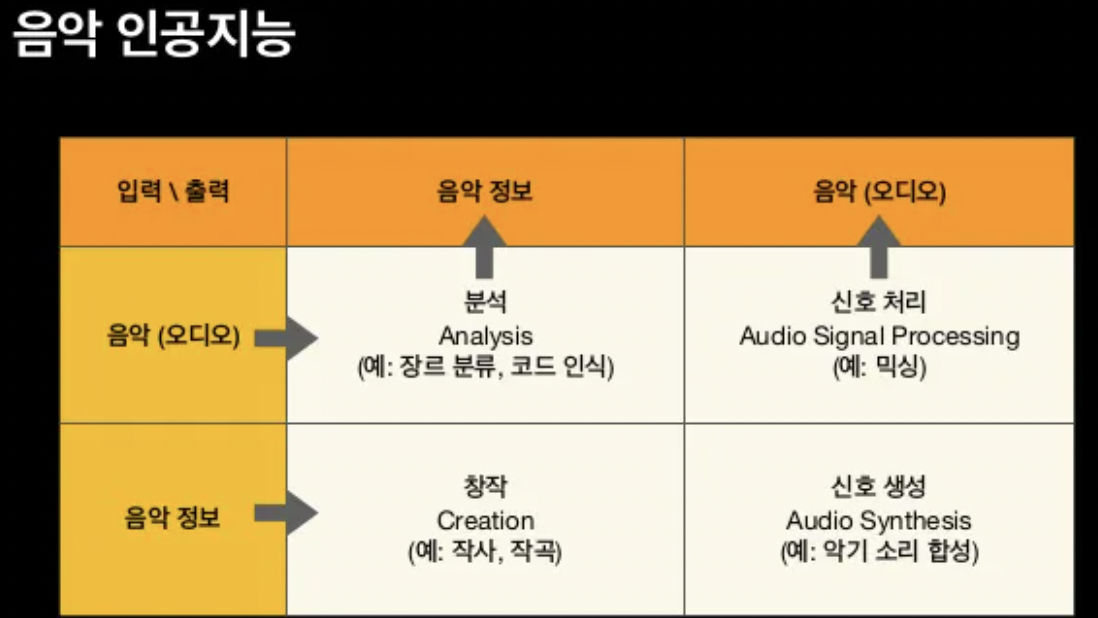

<인공지능의 음악 인지 모델> 발표에서는 음악 인공지능은 기계가 입력에 따라 반응하는 모종의 음악적인 활동(창작, 연주, 분류, 믹싱 등)을 하는 것으로 정의합니다. 거칠게 말해서, 인공지능이라는 학생의 시험 범위 - 공부해야 할 대상이 무엇인가? - 에 따라서, 어느 과목을 공부(입력)해서 어떤 시험을 볼지(출력)에 따라 크게 네 가지 종류로 구분합니다.

음악 정보(information)는 코드, 악보, 멜로디, 장르, 음표, 분위기, 가사 등 곡을 구성하는 다양한 차원의 정보, 오디오는 신호 혹은 소리 그 자체라고 이해하면 되지 싶어요.

※인공지능과 기계학습, 기계학습모델에 대한 범위, 트레이닝/테스팅 데이터 세트 등에 대한 자세한 설명은 이 뉴스레터에서는 다루지 않겠습니다. 현실적으로 위 세 가지 용어를 구분하지 않는 경우가 늘고 있기도 하고요. 좀 더 자세한 이해를 위해 발표를 직접 들으시는 것이 가장 좋습니다!

작사, 작곡하는 AI

일단 발표에서 소개하는 창작 AI란, 악보를 학습하여 코드를 생성하거나, 특정 멜로디를 학습하여 그에 맞는 반주를 생성하는 인공지능을 뜻합니다.

아무 멜로디나 아무 코드를 생성해내는 것이 아니라, 사용자의 의도한 장르(재즈), 코드, 멜로디에 걸맞은 반주 등을 생성하는 세부 영역이 있다네요. 이런 기술이 어디에 활용되고 있을지, 어떤 구체적인 형태가 있을지 저도 좀 더 찾아봤는데요,

- 구글에서 반주해주는 AI duet을 발표했습니다. 이미 5년전 영상이네요.

- AI 작곡으로 유명한 AIVA는 TED에서 멋진 발표도 이미 선보였고요.

- 한국에서도, 인공지능 작곡가가 참여하는 곡이 발매되고 있습니다.

- AI song contest는 2020년부터 개최되기 시작했습니다.

- 작곡만 있는게 아니라 작사도 있죠. 음악으로 표현되는 분위기와 감정을 반영하는 가사를 생성해주는 AI도 발견할 수 있습니다.

믹싱하는 AI

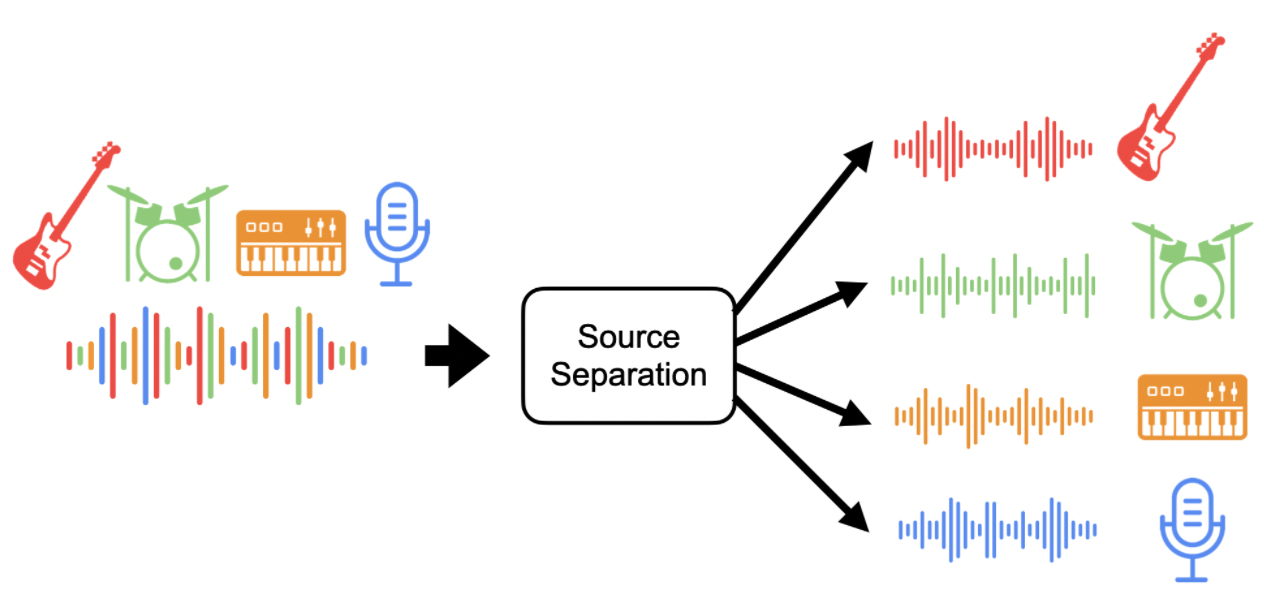

작사 작곡으로 곡을 창작하는 것 외에, 소리를 다듬고 분리하는 영역도 있죠. 신호처리라고 표현되는 영역, 즉 음원 분리, 음질 향상, 잔향 제거, 자동 믹싱/마스터링, 음성 변조 등이 있습니다.

- 바이트댄스에서 음원 분리한 결과물은 이런 것이 있습니다. 사람 목소리만 제거하는 기능이나, 특정 악기 소리를 제거하는 기능도 있습니다. 저는 이 ‘특정’ 악기 소리만 제거할 수 있다는 점이 정말 신기했습니다. 소위 노래방 기기의 훨씬 미래 버전을 연구하고 있군요.

- 음악 외 분야에서도, 이를테면 스포츠 중계에서 관중 소음을 제거하고, 해설만 남기는 것도 가능하고요.

- 명반 리마스터링에도 이 음원 분리 기술이 이용된다고 합니다.

음악을 인식하고 분류하는 AI

음악을 듣고, 이 음악의 분위기는 어떤지, 음색(소리의 3요소 중 하나, 음량, 음고를 제외한 나머지 모든 것이 음색)이 어떤지, 더 나아가 장르를 분류해내는 인공지능입니다.

- 소개해 드리는 발표자료에서는 음색인지 모델, 음표인지 모델, 가사인지 모델 중심으로 설명이 되어 있고요,

- (제가 주로 관심이 있는) 콘텐츠의 메타데이터를 생성해내는 과제도 이쪽에 해당합니다. 고객 행동 데이터를 분석하고, 서비스를 만들어내는 사람들에게 콘텐츠를 분류할 수 있는 ‘태그'가 있는 메타데이터는 필수입니다. (누가 ‘무엇을’ 소비하는지를 이해하기 위해서, 또는 큐레이션을 하기 위해서)

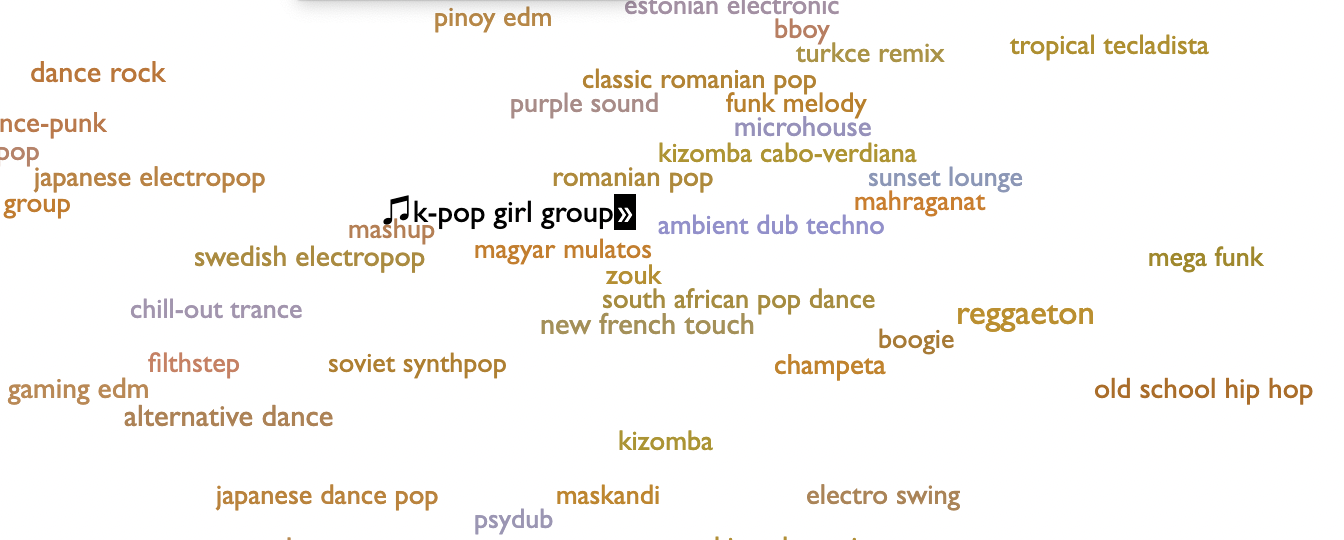

- Spotify가 인수한 Everynoise와 같은 회사는, Echo Nest API를 사용하여 장르 정보를 추출해 준다고 합니다. Spotify가 5천여 개 이상의 장르 정보를 가지고 있을 수 있는 비결이라고 하네요. https://everynoise.com/ 사이트 구경을 한번 추천드립니다! 무지하게 커다란 장르 맵을 볼 수 있고, 각 장르를 누르면 장르에 속한 아티스트 맵이나 장르를 대표하는 곡을 탐색할 수 있어요.

https://everynoise.com/engenremap-kpopgirlgroup.html

- 딥러닝을 활용한 음악 태깅에 대한 발표자님의 연구도 있습니다

노래하고 연주하는 AI

악기 소리나 사람 목소리를 생성해내는 AI도 살펴 볼까요.

- 구글이 DDSP라는 오픈소스 기술을 만들어낸 것이 2020년 10월이군요. 내 목소리로 흥얼댄 것을 악기 소리로 바꿔주는 것이 가능하군요.

- 위와 같이 악기 소리 뿐만 아니라, 내가 원하는 목소리로, 원하는 비트로 노래나 랩을 생성하는 것도 가능합니다. (당장 저에게는... 노래방에 있으면 좋아보이는 기능이네요)

맺으며

자율주행차이니, 메타버스니 세상이 여러모로 빨리 변하고 있는데 AI는 음악산업에서 무얼 하는지 궁금했는데, 위키피디아 에도 음악과 인공지능에 대해서는 (너무나) 간략하게 나열되어 있을 뿐이죠. 저도 이번 기회에 꽤 새로운 부분을 알게 되었습니다. AI 작곡이나 개인화 추천 외에도 활용 분야가 무궁무진하다는 것을요. 리마스터링에도 이미 적용되기 시작한 부분(사운드엔지니어가 마법을 부릴 것으로 보이는 영역이었는데)도 신기하고요. 모바일로 사진을 찍고 보정하는 것이 자연스러워진 것처럼, 삶에 더욱 밀접한 영역에 음악 AI가 다가오는 것도 조만간이겠습니다.

발표자료에서도 언급되는 (아마도 바이트댄스 연구자의 것으로 보이는) 다음 유튜브에서 여러 가지 음악 AI 기술의 현재를 구경할 수 있습니다.

위의 네 가지 AI 외에도, 정보나 신호를 학습하는 게 아니라 시각적 움직임을 받아다가 제어하는 - 내가 움직이는 것으로 오케스트라를 지휘하는 재미있는 실험도 있네요.

이렇게 (아직) 상용화되지 않은 현재의 기술은 분명 다가올 산업의 미래일 것으로 생각합니다. 인공지능이 우리의 삶에 어떻게 침투할지 미리 상상하는 게 저는 참 재밌더라고요. 내년에도 음악산업의 데이터를 들여다보고, 주목할만한 연구나 기술에 대한 동향을 종종 소개해보겠습니다!

의견을 남겨주세요

이알랑

여름님의 글 이번에도 잘 읽고갑니다!

음악파는 김루씨

고맙습니다! 내년 이맘때에는 또 뭐가 달라져있을지..!!

의견을 남겨주세요