우리는 흔히 음악을 “듣는다”고 말합니다

하지만 음악은 단순히 귀로만 듣는 것이 아니었습니다. 우리는 리듬에 반응하고, 몸을 움직이며, 음악의 흐름 속으로 들어갑니다. 음악은 단순히 박자를 맞추는 기술이 아니라 사람의 몸과 감정, 기억이 함께 만들어내는 시간의 예술입니다.

어떤 음악을 들으면 이유를 설명하기 어려운데도 자연스럽게 고개가 끄덕여지고 발끝이 움직입니다. 반대로 연주는 정확하고 깔끔한데도 어딘가 밋밋하게 들리는 음악도 있습니다. 이 차이는 단순히 연주 실력이나 곡의 구조만으로 설명하기 어려운 부분입니다. 음악이 어떻게 흐르는지, 즉 시간을 어떻게 다루는지가 중요한 요소라고 할 수 있죠. 그래서 음악을 오래 해 온 사람들은 자연스럽게 이런 질문을 하게 됩니다.

왜 어떤 음악은 정확하게 연주되었는데도 재미가 없고,

어떤 연주는 조금 흔들리는데도 더 살아 있는 느낌이 드는거지?

그 답은 그루브에 있었습니다.

리듬과 그루브의 차이

우리가 보통 생각하는 리듬은 일정한 간격으로 반복되는 박자입니다. 하지만 실제 음악에서는 그렇게 단순하지 않습니다. 연주자들은 박자 위에서 아주 미세하게 앞뒤로 움직이고 있죠. 어떤 순간에는 박자를 조금 앞당기고, 어떤 순간에는 살짝 늦추기도 합니다. 이런 작은 차이는 악보에는 거의 표시되지 않지만 음악의 느낌을 크게 바꾸는 요소입니다.

재즈에서는 이런 특징이 특히 잘 드러납니다. 메트로놈처럼 정확한 리듬은 오히려 음악을 평면적으로 만드는 반면, 연주자가 음을 조금 앞당기거나 늦추면 리듬에 긴장과 여유가 생겼습니다. 재즈 연주자들이 말하는 푸쉬(push)와 레이백(lay back)이 바로 그런 개념이죠.

푸쉬는 리듬을 조금 앞으로 밀어 연주하는 감각입니다. 반대로 레이백은 리듬을 조금 뒤로 기 대는 감각입니다. 이 두 가지 사이에서 만들어지는 미묘한 긴장과 여유가 바로 우리가 말하는 그루브입니다.

이러한 미세한 시간 차이의 개념을 마이크로타이밍(micro timing)이라고 부릅니다. 몇 밀리초(ms) 정도의 아주 작은 차이지만, 이 차이가 음악의 에너지와 분위기를 크게 바꾸었습니다. 인간의 연주에는 항상 이런 미묘한 흔들림이 포함되어 있었습니다. 오히려 너무 정확한 리듬보다 약간의 어긋남이 있을 때 음악은 더 자연스럽고 인간적으로 들렸습니다.

인공지능도 마이크로타이밍으로 연주 할까?

여기에서 흥미로운 질문을 해보았습니다. '인공지능도 이런 리듬 감각을 이해할 수 있을까?'

오늘날 인공지능은 이미 많은 음악을 만들어내고 있습니다. 수많은 데이터를 학습해 코드 진행에 맞는 멜로디와 리듬을 만들어내고, 특정 장르의 스타일을 따라 하는 것도 가능합니다. AI가 만든 음악을 들어 보면 꽤 완성도가 높다고 느껴지기도 합니다. 하지만 앞서 이야기했듯이 음악은 단순한 패턴의 조합만으로 만들어지지 않는 것입니다. 연주자가 박자보다 조금 앞서거나 늦추는 순간, 그 작은 차이에서 음악의 생동감이 만들어집니다. 이런 미묘한 변화는 단순한 계산이나 규칙만으로 설명하기 어려운 것이겠죠.

실제로 AI가 만든 음악을 분석해 보면 구조적으로는 매우 정교했습니다. 코드 진행과 리듬 패턴도 잘 맞았습니다. 그러나 인간 연주와 비교하면 차이가 보였습니다. 인간의 연주는 부드럽게 흔들리는 곡선처럼 변화가 있었지만, AI의 리듬은 대부분 정확한 박자에 맞춰진 직선에 가까웠습니다.

다시 말해 AI는 리듬을 계산할 수는 있었지만, 아직 리듬을 ‘탄다’고 말하기는 어려운 상태입니다. 하지만 이것이 AI의 한계만을 의미하는 것은 아니었습니다. 오히려 여기에서 새로운 가능성이 보였죠.

위대한 베이시스트의 워킹베이스를 분석하다

연구진은 해외의 저명한 베이스 아티스트인 크리스챤 맥브라이드, 폴 챔버스, 론 카터의 실제 녹음본 중 30곡을 선정하여 워킹베이스 4비트를 8마디씩 데이터화 하여 푸쉬와 레이백의 간격을 기록했습니다. 그리고 이를 Melodyne, Spectralayers, Sonic Visualiser 등의 분석 도구를 사용해 데이터화 하고, 이 구조를 개선시키며 설계와 학습을 진행했습니다.

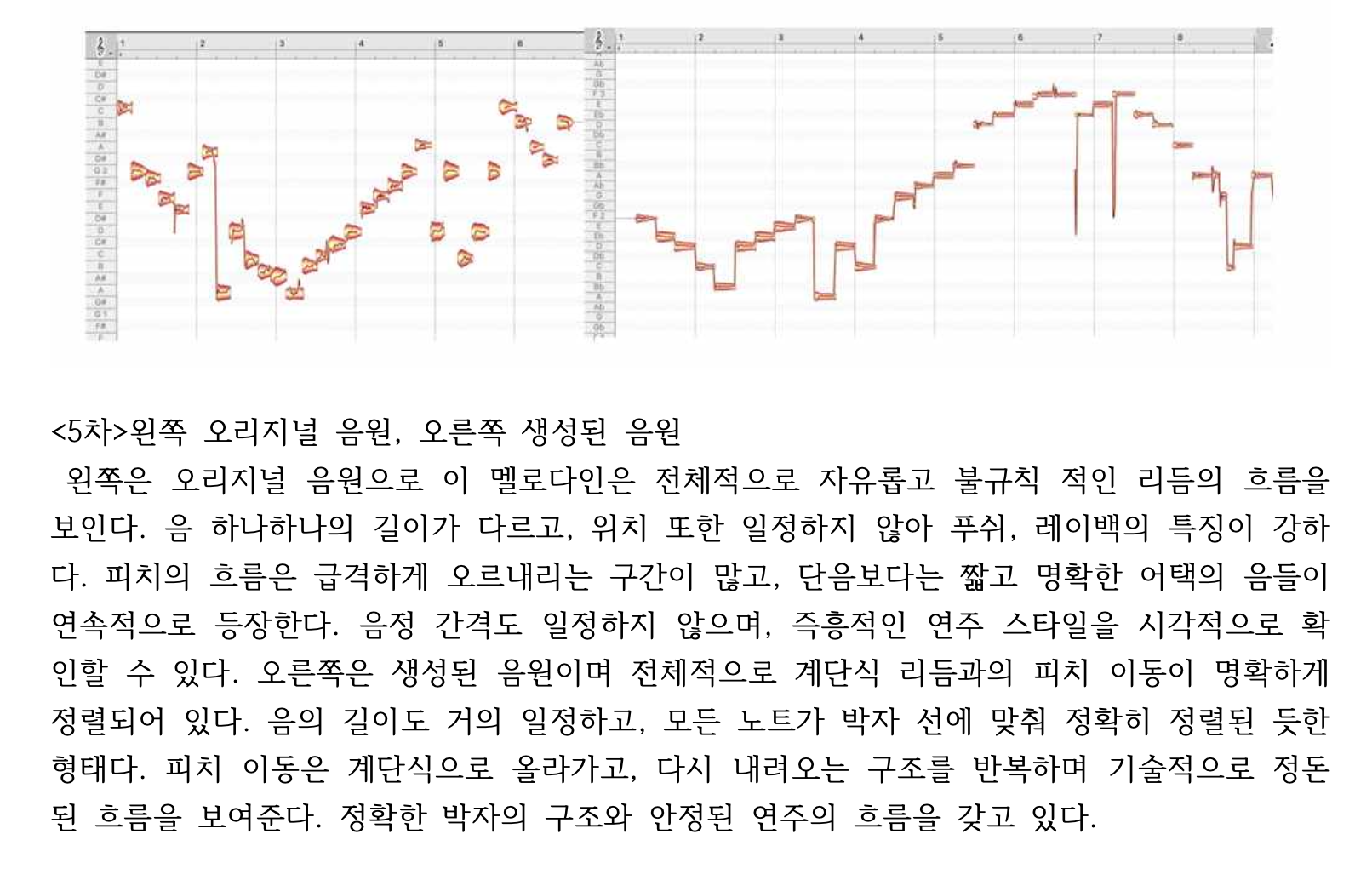

그 결과는 어땠을까요? 여러 차례의 실험 끝에 5차 실험에서는 오리지널 음원과 생성된 음원의 그루브가 점점 닮아가는 변화를 확인할 수 있었습니다.

음악은 계산만으로 완성되지 않았습니다. 악보와 이론, 데이터와 알고리즘이 아무리 발전해도 음악의 중심에는 여전히 인간의 감각이 남아 있었습니다. 그 감각은 몸의 움직임과 호흡, 그리고 연주자와 청자가 함께 느끼는 시간 속에서 만들어집니다. 어쩌면 그루브란 인간이 시간 속에 남긴 흔적일지도 모릅니다. 그리고 인공지능이 그 흔적을 따라 배우는 과정은 단순히 기술의 발전이 아니라, 우리가 음악을 어떻게 느끼는지를 다시 생각하게 만드는 과정이었습니다.

언젠가 AI가 정말로 그루브를 타는 순간이 온다면, 그때 우리는 새로운 기술을 만나는 것이 아니라 인간과 기계가 함께 음악을 느끼는 새로운 시대를 맞이하게 될지도 모릅니다.

의견을 남겨주세요